眼擎科技eyemore成像引擎被吹捧过度?真能让机器拥有人眼?

人工智能

描述

【导读】:最新,眼擎科技eyemore成像引擎随处可见,让机器拥有人眼,真有那么厉害还是吹捧过度呢?

视觉“识别”是人工智能时代下,对安防行业而言最重要的技术之一,但目前无论是人脸识别还是车辆识别,都面临着被复杂光线影响的问题,而后端算法只能做到在特定场景、特定光线状况下,对物体进行有效识别,可一旦光线发生了变化,识别率就会大打折扣。

“机器视觉不能重蹈语音识别的覆辙。”眼擎科技CEO朱继志告诉亿欧,语音识别技术已经宣称识别率达到99%,但却迟迟无法在生活场景中大规模应用,原因就在于“99%的数据是在安静的实验室中得出的,而生活场景中有大量的噪音,这对识别产生了巨大的干扰。”同理,在视觉识别中,摄像头正常光照下的成像AI识别率能接近100%,但实际部署中不可避免会遇到弱光、逆光、反光等复杂光的影响,所以现实中算法识别率远不能达到实验室的“理论”效果。

“大脑要强,但如果感知端无法传输有效的信息,那么大脑再强也没有用。”针对当前AI成像的问题,朱继志于2014年创立了眼擎科技,研发超越人眼视觉能力的成像引擎技术及芯片,解决数码成像在弱光、逆光、反光等复杂光环境下成像的痛点。

AI视觉新问题:大脑够强了,眼睛却跟不上

在安防领域,每年摄像头出货量超过1亿台,人脸识别、车辆识别等算法的成熟持续带动着安防市场扩大,但在实际应用中,“识别”受到了诸多环境因素的限制,其中最重要一个挑战就是复杂光线。

“如果将整个识别的系统比作一个人,我们现在已经有很强的大脑了,但眼睛却跟不上。”朱继志告诉亿欧,要对人脸、车辆进行识别的前提条件,是前端摄像头能够传回清晰的画面。但现在的问题是,在光线环境足够好的时候,“大脑”对画面内容的识别率能接近100%;但在弱光、逆光、反光等复杂光环境下,由于无法接收到清晰的画面,“大脑”对画面内容的识别率大打折扣。

为了解决复杂光问题,业内出现了各种各样的应对方法。针对黑暗或弱光环境,可以使用红外线,或者直接在摄像头旁加装一盏灯,“但这些方法只能解决一部分的光问题,而且还有’副作用’。”朱继志说,红外线只能在近距离发挥作用,而且成像噪点大,画质极易受到干扰;而加装灯的方法只在某些场景下可行,“比如晚上在闸机口处加装灯是可行的,但在公路上抓拍车辆的场景却不合适。”朱继志说道,大多数司机都对夜晚路过抓拍机的爆闪灯“有很不好的体验”,但如果不加装爆闪灯,监控设备就无法正常捕捉到车辆信息。

解决单一非正常光环境的方法已经不尽如人意了,而前端设备需要面临的远不止一种光环境。朱继志告诉亿欧,弱光、逆光、反光等只是复杂光线下的几种典型,而大部分在户外使用的摄像头需要面临的却是多种复杂光线交替出现的场景。

以闸机口为例,摄像头架设的位置和方向是固定的,但一天中光线的强弱、光源位置都会发生变化。“早上太阳从东边升起,傍晚从西边落下,到了晚上又是黑的。”朱继志说,如果摄像机朝向东方,则早上逆光现象就会非常严重,朝向西边也是同理,到了晚上又是弱光,而通常情况下算法只能针对其中一种状况作出优化,这给闸机的高效识别带来巨大的挑战。

打破被日系企业垄断的ISP架构

不解决弱光、逆光、反光等复杂光环境下的自适应能力,AI视觉产品就无法大规模落地进行产业化。但要怎么做才能解决这个问题呢?

朱继志认为,这个问题的出路在前端。“无论是什么样的光环境,只要前端设备面临负责光线对成像的干扰时,依然能够输出如同正常光环境下成像的效果。那么企业在后端算法上就不需要再做过多的定制,如此一来,企业就能够生产更多标准化的产品,提升企业、乃至整个行业的效率。”

要改造前端设备,首先需要了解当前摄像机成像的原理,以及存在的问题。

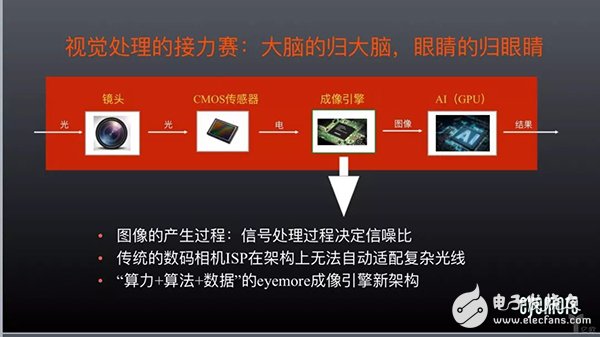

朱继志介绍道,在数码时代,摄像头成像需要经历几个环节。首先,光线穿过镜头后,要经过CMOS传感器,CMOS会将光信号转化为电信号,“但这个电信号是很粗糙的,”朱继志说,“如果要将它再转化成一张可视化的图像,就要再经过ISP。”

ISP全称为Image Signal Processing,即图像信号处理,主要用来对前端图像传感器输出信号处理进行处理。ISP架构能够通过一些列的工作,实现自动光圈、自动曝光、自动白平衡等功能,让电信号真正变成一张可看的图像。

“但传统的ISP架构有两大问题。”朱继志说。第一个问题是所有RAW数据在进入ISP架构时,会直接从16位被裁成8位,导致了大量RAW数据信息丢失。RAW是一个单独的数据流,如果16位的信息变成8位,那么再转换成JPG格式图片时,图片信息就会比原始的RAW数据信息少256倍。“这就是为什么图像在逆光、反光等复杂光环境下质量不高、成像不清晰的原因。”

另一个问题是,ISP架构所有核心技术都被日本企业掌握。“日本公司是成像行业的头部企业,如果他们都不对ISP架构进行突破,那其他公司更加不可能做出大的改变。”朱继志说道。

但成像中存在的痛点深深影响着AI视觉产品的大规模落地是不争的事实。既然无法改变传统的ISP架构,那就一定要在技术上进行创新。秉着这样的初衷,眼擎科技完全抛弃了日系成像技术的ISP架构,打破了日系厂商在成像领域的技术垄断,开发出了全新的“成像引擎”。

从“给人看”到“给机器看

“如果一个问题存在了很久,都没有被现有架构解决,这说明一定要有全新的技术架构才能破解难题。”朱继志告诉亿欧,眼擎科技开发的“成像引擎”就是这样一个解决复杂光环境下AI视觉成像问题的全新架构。

“传统ISP架构的目的是为了实现成像这个功能,”朱继志说,“但成像引擎重视的是成像的性能。”

据了解,成像引擎是一个“算力+算法+数据”的全新成像架构,具有学习功能。朱继志向亿欧介绍道,处理图片是一个十分复杂的过程,因此算力对成像引擎而言十分重要;但光有算力是不够的,还要开发出针对不同场景的算法,才能解决实际应用中的问题;在算力和算法都具备的条件下,最终还需要在不同复杂光环境下进行测试,以收集到更多的场景数据,让算法进行学习,达到让整个成像引擎能够适应多种复杂光环境的目的。

在成像引擎实际运作中,“经过CMOS的8~16位RAW数据进来时,我们直接基于RAW数据进行无裁剪处理,如果按照16位的数据来算,成像引擎处理的原始图像信息量比传统ISP高256倍,最后把它压缩成8位的JPG图像。”朱继志说,这样的方法能够保留所有图像细节信息,无论在什么光线环境下,都能对图像实现优质处理。

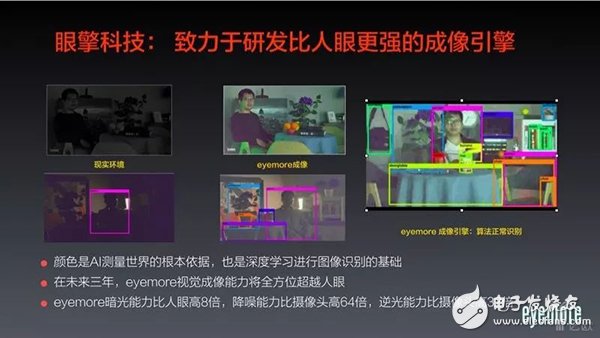

“颜色是AI测量世界的根本依据,也是深度学习进行图像识别的基础。”朱继志认为,成像技术的目的已经从“给人看”过渡到“给机器看”,“AI视觉需要的是一把标尺,关注的不是美颜、像素,而是准确的输出物体的颜色、锐度以及丰富的细节。”

据了解目前成像引擎暗光能力比人眼高8倍,降噪能力比摄像头高64倍,逆光能力比摄像头高32倍。未来三年,眼擎科技的使命就是让成像引擎芯片的成像能力将全方位超越人眼。

AI视觉的“最后一公里”

今年1月,眼擎科技推出了完全自主研发的全球首款复杂光线专用成像芯片eyemoreX42。除了成像芯片,眼擎科技也通过提供成像开发套件、成像模组、成像算法IP以及深度定制成像方案等一系列全套的成像技术方案及服务。

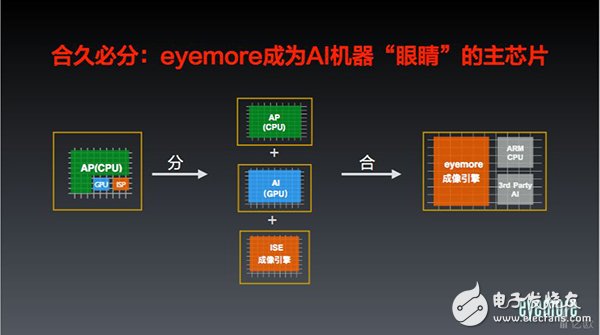

“我们定位是一家上游的芯片公司。”朱继志告诉亿欧。传统ISP架构集成在SoC里面,而眼擎科技抛弃ISP架构后,需要填补成像技术的空白,但眼擎科技的成像引擎是一个“算力+算法+数据”的全新成像架构,原来ISP在SoC中所处的位置无法承担成像引擎的处理能力,“所以我们要单独生产一个芯片来实现成像引擎的功能。”

“AI正驱动着芯片产业发生变化。”朱继志告诉亿欧,以前CPU一家独大,摄像机里只需要一个主芯片就能实现所有功能;但AI时代来临后,GPU的重要性就体现出来了,所有算法都是基于GPU实现,因此摄像机中需要加入GPU;但当GPU的算力变得很强、算法很丰富的时候,前端摄像头能力的好坏就成了AI视觉“最后一公里”的关键问题,因此还需要一款新的成像芯片来解决这个问题,眼擎科技解决的正是这“最后一公里”的问题。

朱继志表示,眼擎科技的愿景是成为AI成像领域的头部企业,定位上游的技术方案商,通过赋能的方式,向下游打造终端产品的公司输出自己的成像能力。据了解,眼擎科技未来将在安防、工业检测、无人零售、智能医疗、机器人、深度相机等领域重点发力。

“我们是面向未来的,关注的是新产品和新应用市场。”朱继志告诉亿欧,眼擎科技的战略是先做核心技术突破,再找市场应用部署,“场景与技术是相互推动的,场景的需求能催生技术的更新,而技术的创新能’解锁’更多应用场景。”朱继志说,比如在安防领域,眼擎的全新成像技术将变革闸机的场景,未来闸机处的摄像头不再需要任何辅助光源,也能清晰的“看”见人和物;同样,“未来公路上有爆闪灯,可能也会变成一件奇怪的事。”

今年是眼擎科技启动市场推广的第一年,朱继志认为,将芯片推向市场需要2年的时间,之后还要再用2年的时间等待市场成熟。“AI视觉成像能力的改变并不是一蹴而就的,而是一个慢慢迭代升级的过程。”朱继志说,只讲技术原理,安防圈子的人都懂,但只有看到成像引擎的实际效果,市场才能对这个原创技术有最直观的感知,“用户体验这种主观的感觉是很难说清楚的,所以还需要时间让大家慢慢了解和接受。”

eyemore成像引擎,是否真像口头说得那么厉害,只有到真正商用级别的时候才能见真章,更希望中国IOT大会中能够见到眼擎科技带来的干货,在此我们满怀期待,静候眼擎科技佳音。

-

鱼眼相机的成像原理与成像模型解析2022-09-26 6715

-

请问有机器人眼的工作原理图吗?2019-11-08 2668

-

均衡放大过度不利于串行连接的原因2018-08-29 1414

-

四年造芯,他颠覆传统ISP架构,以成像引擎技术打造机器之眼2018-06-20 5815

-

眼擎科技给机器一双人眼,让AI图像识别适应复杂光线2018-05-15 2912

-

眼擎科技新推AI成像芯片 给无人车一双人眼2018-04-19 1508

-

眼擎科技芯片承载成像引擎 为AI机器打造视觉器官2018-03-09 1471

-

眼擎科技正式发布一款完全自主研发的AI视觉成像芯片2018-01-23 4363

-

AI视觉公司眼擎科技发布eyemoreX42成像芯片2018-01-21 1031

全部0条评论

快来发表一下你的评论吧 !