在实际环境中测试Wi-Fi吞吐量来评估射频抗干扰能力就是一个伪命题

RF/无线

描述

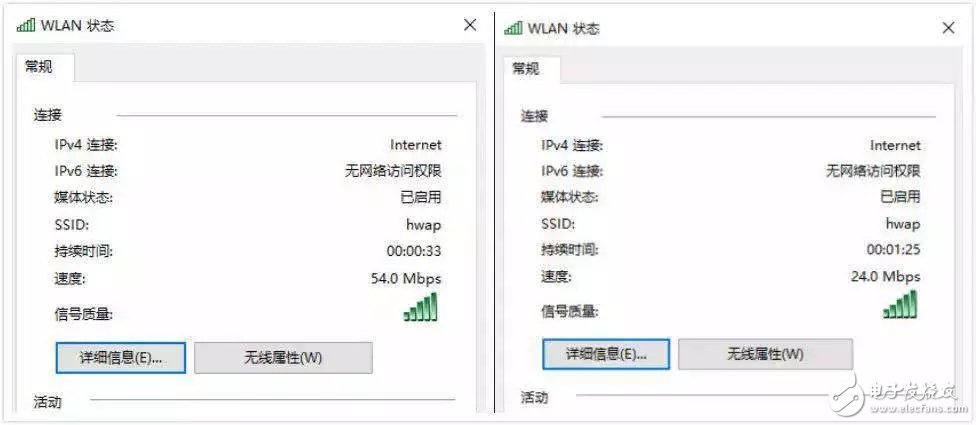

前几日,好基友分享给小编几张图片,小编看到有了想要撞墙的冲动。

相信看到这些图的工程师们,脑子会瞬间浮现超多苦涩而无奈的场景:

A:你的产品设计有问题,你看吞吐量值一时高一时低,相差极大…。.

B:在同一个办公室里,我用手机在同一个位置测试Wi-Fi吞吐量值比你的高…。

C:我在办公室对比了你们的产品和竞品的Wi-Fi吞吐量…。.

D:你的产品无线传屏功能有问题,我在办公室传输图像和视频会出现卡顿…。

E:我在办公室里用手机连你的产品测试Wi-Fi吞吐量,就将手机转了90度,吞吐量值掉了一半,你的产品稳定性有问题…。.

F:我要在办公室这种实际应用环境中,测试下Wi-Fi吞吐量,看看在实际环境中,你的产品Wi-Fi的吞吐量以及抗干扰能力怎么样……

大家是否也经历着小编之前经历过的绝望呢?不过小编的心可是想着大家呢~作为一个踩坑大圣,班妹决定今天跟大家分享一波绕坑秘籍~~

敲黑板:今日重点

一、 Wi-Fi的理论速率是个啥?

二、 这些个理论速率有什么依据?

三、 Wi-Fi的理论速率是怎么计算的?

四、 为啥Wi-Fi的理论速率还可以一直变?

五、香侬定理与Wi-Fi理论速率

六、Wi-Fi射频应用之基本原理

七、Wi-Fi射频干扰

八、总结

一、Wi-Fi的理论速率是个啥?

基友发的图片上的“速度”就是通过电脑网卡读出来的Wi-Fi的理论速率。(是哪个Wi-Fi协议的理论速率,各位看官自己猜)

Wi-Fi的理论速率是根据不同的调制方式、码率、单个子载波承载编码字节位数、承载数据的子载波总数、空间流数、单次Wi-Fi数据传输耗费的时间等信息计算出来的。

二、这些个理论速率有什么依据?

当然有依据!

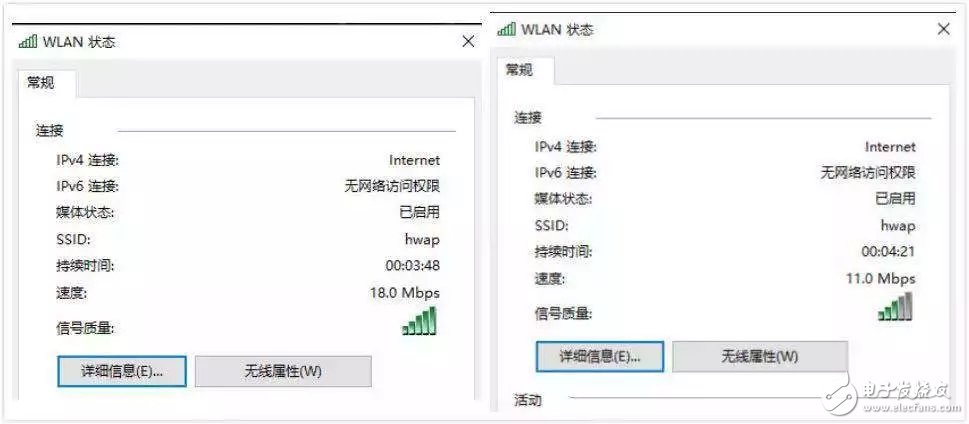

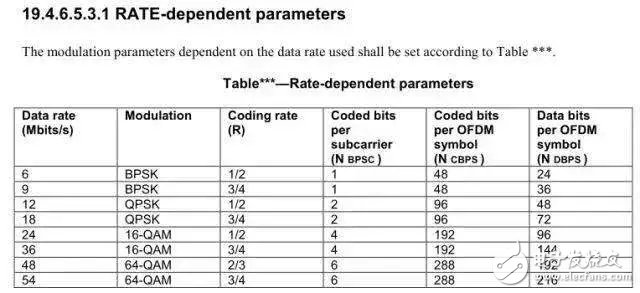

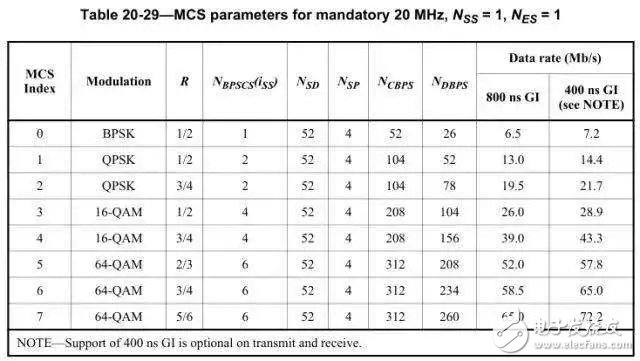

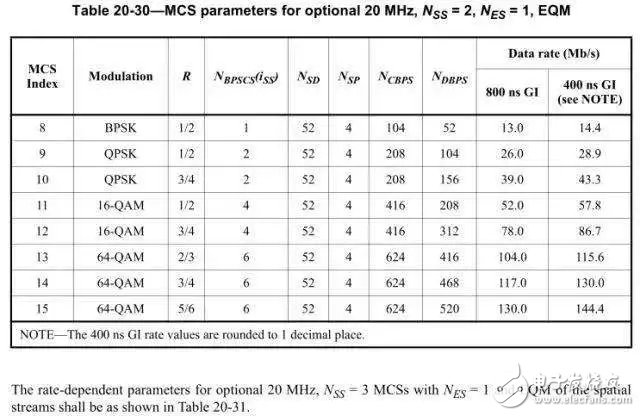

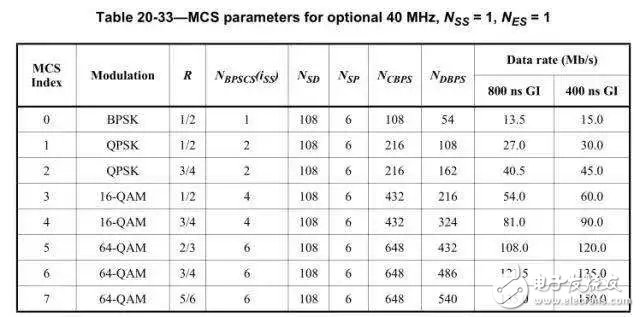

请看下图IEEE 802.11g(图1)以及IEEE 802.11n(图2、图3、图4)协议所列举出来的部分理论速率:

(图1:IEEE 802.11g理论速率集)

(图2:IEEE 802.11n-HT20 1T/R理论速率集)

(图3:IEEE 802.11n-HT20 2T/R理论速率集)

(图4:IEEE 802.11n-HT40 1T/R理论速率集)

三、Wi-Fi的理论速率是怎么计算的?

举个栗子,802.11n-HT20-MCS7这个模式下的理论速率是如何计算的:( 插个话,802.11n协议是支持2.4G和5.8G双频的哈)

1、每次Wi-Fi数据传输的时间是4μs (这点所有的Wi-Fi协议都相同);

2、MCS7采用的是64-QAM的调制技术(可参考上图),意即每个子载波每次可传输6bit(2的6次方=64)数据,速率为MCS7时,其对应的码率(coding rate)是5/6;

3、HT20时,OFDM将20M带宽分割成56个子载波,用于传输数据的子载波数目为52;(参考图2 MCS7时,Nsd=52,Nsd :Number of complex data numbers per spatial stream per OFDM symbol)

4、所以在HT20的MCS7时,速率=(1/4us)*(52*6bit)*5/6 = 65Mbit/s,而当有多空间流时,乘以同时工作的空间流(天线根数)即可,安装的假天线不算。其它速率的计算方式是一样的。

备注:Wi-Fi单次数据传输时间4μs对所有模式都是一样的,参考如下计算:

4μs=Ndbps/DR;Ndbps= Number of data bits per OFDM symbol即为每个OFDM符号传输的数据比特率(可参考图1、2、3、4),DR=Data Rate;对802.11g-54Mbps时,传输时间=(Ndbps =216)/54Mbps=4μs;对802.11n-HT40-MCS7 1T/R时,传输时间=(Ndbps=540)/135Mbps=4μs

四、 为啥Wi-Fi的理论速率还可以一直变?

Wi-Fi的理论速率的大小其实体现的是当前空口信道质量的变化。

在进行传输时,Wi-Fi的数据报文最开始通常会以设备支持的编码效率最高的协议速率在空中信道发起传输(协商),但此时当前信道因为信号强度、距离、干扰等因素,可能会造成数据的传输中出现较大的时延和误码时,为了能更有效的抑制数据传输的时延和误码,802.11系列Wi-Fi协议规定此时的Wi-Fi设备需采用对信道环境要求相对较低的调制编码方式来提高数据报文在空口中抗误码和时延的能力。

如基友发过来的图中速率短时间内就从64-QAM (54Mbps)调整成CCK (12Mbps),但提升抗误码能力的同时,却牺牲了数据的编码效率,这个时候体现出来的就是空口协议速率的变小,也就是理论速率的变小,这也就是大家经常说的Wi-Fi降速率。

在办公室环境中,由于Wi-Fi信道环境一直处于动态变化中,极端情况下,甚至会出现时而能连上,时而断线的情况,其理论速率也一直在变化,吞吐量实测数据也会一直动态变化。

五、香侬定理与Wi-Fi理论速率

Shannon老先生在上个世纪就提出了基于理想高斯白噪声干扰信道容量、信噪比、容量的定理(如下公式),与奈奎斯特定理不同的是,它选用的信道模型是存在噪声干扰的,更接近实际通信数据交互。

C=B log2(1+S/N)

C为信道容量、B为带宽、S/N为信噪比。(名词公式虽枯燥,但理论之树常青)

其中,信道容量C可以理解为不同的B、S/N状态下,所使用信道最大的理论传输速率。结合Wi-Fi 802.11协议,比如802.11b,其在20MHz带宽(实际是22MHz)在特定的S/N范围内(该值与芯片性能相关),其C值可以表征为11Mbps,而此时使用的调制方式为CCK;同理,在802.11n-HT20 –MCS7 1T/R值时,其C值可以表征为65Mbps(如支持GI=400ns,为72.2Mbps)

而对Wi-Fi吞吐量测试而言,带宽B确定以后,其理论速率与信噪比是成正相关的,信噪比越高,理论速率就越大;换言之,信噪比此时就成为当前Wi-Fi信道通信环境及通信质量的重要评估指标,是当前空口信道质量好坏的体现,也是前面中提到的码率、调制解调、编码方式等算法调整及切换的重要依据,当前信道信噪比变化超过一定阈值时,Wi-Fi的理论速率、调制方式等会做自适应切换。

实际上,对一些相对专业的无线终端厂商,他们即使在专业测试吞吐量的实验室,都会从芯片端去读取当前测试环境中的S/N、以及Noise值作为测试的参考依据。

六、Wi-Fi射频应用之基本原理

在办公室(家庭或者公共场合)使用Wi-Fi过程中,经常会出现网速慢、网络时延大和掉线等现象,造成这种现象的原因,除信号覆盖不佳和Wi-Fi终端设备负荷过重外(产品的数据处理能力欠佳导致),比较常见的因素,就是射频干扰。

但Wi-Fi的射频干扰除常见的其他无线系统对Wi-Fi的共存干扰、Wi-Fi终端的相邻信道干扰,以及Wi-Fi射频物理层上受到的干扰外(如产品本身的电源、DDR等对Wi-Fi的干扰),还存在一种这样的情况:

当大量Wi-Fi终端共享一个相同的空口信道进行持续性较大流量数据传输时(如播放高清视频),会加大信道中数据帧冲突的概率,增多数据帧的重发频率,导致当前信道的信噪比变差,单数据帧的传输时间变长,最终只能通过降低空口信道的传输效率、速率(当然在专业测试吞吐量的实验室不会出现此种情况)来维持基本的通信。而当空口负荷增大到一定程度时,就会出现影响用户体验的网速慢、丢包,甚至掉线等现象。

那么是如何出现这种情况的呢?前方又高能了!

1)时隙碰撞、网络延时与丢包的产生

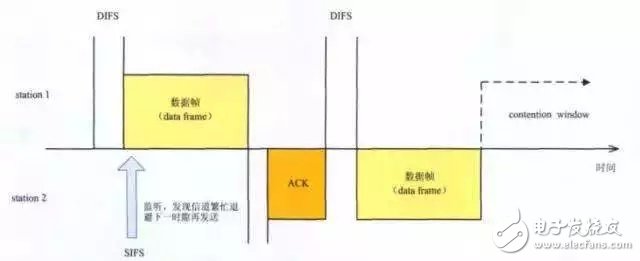

如大家知道,Wi-Fi的空口信道是一个 TDD(时分双工)时分系统,其一个基本数据帧操作是由多个帧结构组成,帧之间以“帧间间隔”加以区分。访问 802.11 媒介时,通常以分布式帧间间隔(DIFS)为起点,开始整个帧交换序列,之后的帧则以短帧间间隔(SIFS)加以区分。一个基本的数据帧传送流程见图 5。

图5

如上图,当 station 1 在某一个时隙中传输数据时,station 2 发起监听信道的请求。这时,由于信道已被占用, station2 只能等待避让一个随机的时隙后,再次监听该信道,直到信道空闲并且持续了一个 DIFS 的时间后,才可以传递相关数据帧,之后等候 ACK,ACK 经过一个 SIFS 的时间后反馈。

而在信道被利用频繁的时候,多个 station监听到信道空闲后,同时发送数据,继而在该时隙上出现碰撞,导致数据传递不成功,无 ACK(确认帧)返回,于是再次重传,网络时延因为重传变大。

通常对于长帧的重传设置规定为 7 次,即此数据帧当退避重传 7 次仍无 ACK 响应后,则丢弃此数据帧,这时,对于网络应用而言,出现误码丢包现象。

这就是Wi-Fi的载波监听与冲突避让机制。

2)延时与误码导致选用更低阶调制方式

当由于信号强度、距离、干扰等因素,造成在数据的传输中出现较大的时延和误码时甚至丢包时,为了能更有效缓解时延和误码,保证数据传递的准确性,802.11协议规定Wi-Fi终端设备需采用更低阶编码方式(如基友的例子,从64QAM 54Mbps 调整到CCK 11Mbps ),来提高数据报文在空口中抗误码和时延的能力。此机制的好处是可以提升抗误码能力,坏处是,降低了编码的效率。

具体到AP/STA设备而言,当出现较多时延、误码、丢包等现象时,它们会认为空口信道质量出现恶化,于是依据信道环境逐级采用有较强抗干扰能力的编码方式来进行数据传输,而越低阶的编码方式,其编码效率越低、数据帧的占用时隙越大,最终这种方式导致每数据帧的时隙逐渐增大。

空口信道理论速率的降低,导致每个数据帧的长度增加(单次Wi-Fi数据传输时间都是4μs),又进一步加剧空口信道上的冲突竞争;当竞争加剧到一定程度,又迫使所有终端采用抗误码能力更强的编码方式即更低阶的调制方式来保证数据传输的质量,从而就像多米诺骨牌一样,进入恶性循环。

3)低阶调制方式意味着较低的每符号比特数

在 802.11 协议中,高速率的无线数据接入能力主要源于其所采用的多载波调制技术 OFDM(正交频分复用调制)。OFDM采用n-QAM ,n 表示各种调制映射到星座图上的模数。由于星座图上的点位需精确定位以实现能被正确解调,所以,模数越低也就是越低阶的调制方式,其对信号传输条件的要求越低,也就更能适应恶劣的空口传输环境。

但通过调整编码方式,提高抗干扰能力的同时,却降低了每符号 bit数,继而理论传输速率也相应下降。(如图6: 64-QAM及256QAM星座图所示;图7: 256QAM星座图第一象限)。

图6

图7

七、Wi-Fi射频干扰

如第六部分所述,Wi-Fi的射频干扰有:其他无线系统对Wi-Fi的共存干扰、Wi-Fi终端的相邻信道干扰、Wi-Fi射频物理层上受到的干扰、以及Wi-Fi 载波监听与冲突避让机制导致的同信道干扰。

如下数据为两种典型的Wi-Fi射频受到干扰的数据,供参考:

1)Wi-Fi蓝牙共存干扰吞吐量对比数据

图8为在吞吐量实验室只进行Wi-Fi连接的数据,图9为测试Wi-Fi吞吐量时,打开蓝牙连接蓝牙音箱的数据,测试模式均为802.11n-HT20

图8

图9

2)微波炉对Wi-Fi的干扰

图10为在家用环境中测试笔记本Wi-Fi吞吐量时,打开与关闭微波炉时的Wi-Fi吞吐量数据变化。

图10

3)4G信号对Wi-Fi的干扰

图11为不同手持设备测试Wi-Fi OTA TIS时,连接与关闭LTE Band 7 (UL = 2 505 MHz)对2.4G不同 Wi-Fi信道 TIS数据的影响。图12为设备打开LTE Band 7 (UL = 2 505 MHz)与工作在Wi-Fi ch13时的频谱。

图11

图12

八、总结

办公室、家庭等实际传输环境情况较复杂,除了各种无线系统的共存干扰、Wi-Fi射频物理层上可能受到的干扰外,还有Wi-Fi自身载波监听与冲突避让机制导致空口信道拥塞、理论速率降低的自干扰,而这个是Wi-Fi本身的通信机制所致,只要在实际环境中使用Wi-Fi就无法避免。

以上这些情况是都是无法在实际环境中通过Wi-Fi吞吐量测试量化评估Wi-Fi产品无线性能稳定性、以及Wi-Fi产品在实际环境中的抗干扰能力的原因,通过在实际环境中测试Wi-Fi吞吐量来量化评估产品的射频抗干扰能力本身就是一个伪命题。

-

Wi-Fi 8:开启极高可靠性 (UHR) 连接的新纪元——12025-06-13 846

-

SimpleLink Wi-Fi 天线选择2015-03-12 3608

-

AP和网络运行方式低功耗Wi-Fi2018-09-03 3250

-

SimpleLink Wi-Fi天线BoosterPack评估2018-12-17 2636

-

智能Wi-Fi射频干扰问题及其解决方案介绍2019-06-14 1713

-

Wi-Fi信号干扰问题该怎么解决?2019-08-14 3802

-

三类Wi-Fi滤波器浅析2020-07-02 10614

-

ESP32C3射频测试,是否需要使用Wi-Fi Adaptivity方法来进行Wi-Fi范围测试?2023-04-12 815

-

Wi-Fi协议中的MIMO技术是什么2023-05-05 12835

-

影响Wi-Fi吞吐量的几个坏蛋,你知道几个?2018-10-22 5484

-

设计人员如何实现 Wi-Fi 三频段千兆网速和高吞吐量2022-12-26 1709

-

揭开Wi-Fi技术演变的神秘面纱2023-05-17 1433

-

华为完成业界首个Wi-Fi 7 AP性能测试2023-11-09 1874

-

Wi-Fi 6和Wi-Fi 5之间有哪些区别呢?2023-12-09 6007

-

LitePoint探讨Wi-Fi 8在实际部署中面临的挑战2026-03-26 3257

全部0条评论

快来发表一下你的评论吧 !