瑞芯微(EASY EAI)RV1126B 手势识别算法识别

描述

1. 手势识别算法简介

Gestures手势识别算法一种先进的姿势估计模型,使用 关键点数据集进行训练,能够检测图像或视频中人物的 21个关键点与26种手势,每个关键点代表手部的不同部位。该算法广泛应用于体育分析、动物行为监测和机器人等领域,帮助机器实时解读物理动作。Gestures手势识别的特性和改进,提升了性能和灵活性,使其成为各种计算机视觉任务的理想选择。本算法具有运行效率高、实时性强的特点。

基于EASY-EAI-Nano-TB(RV1126B)硬件主板的运行效率:

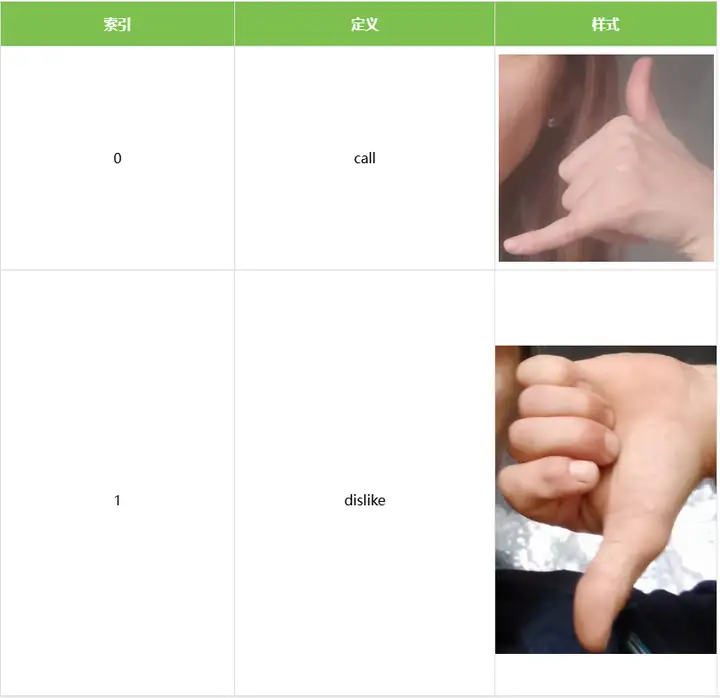

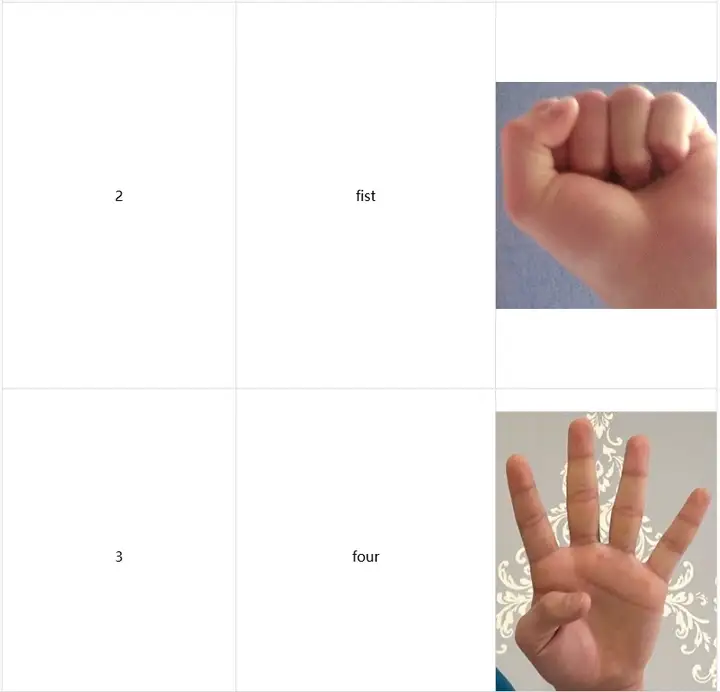

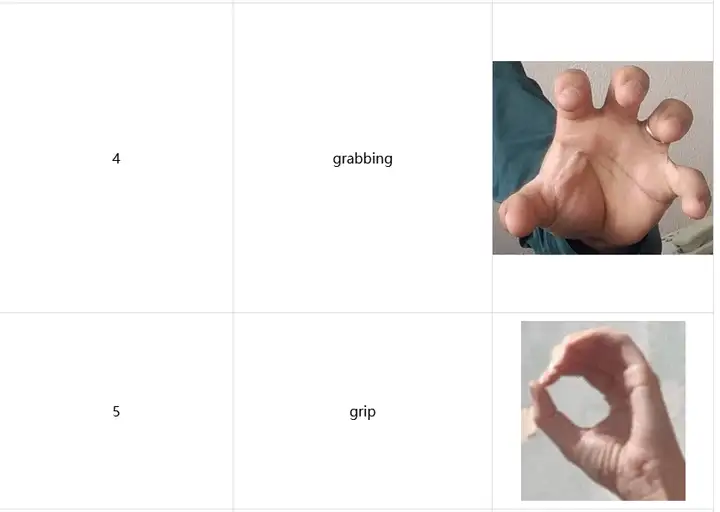

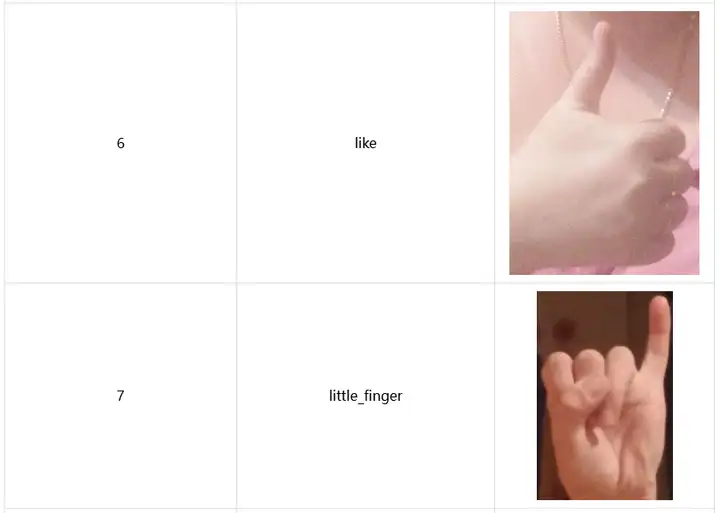

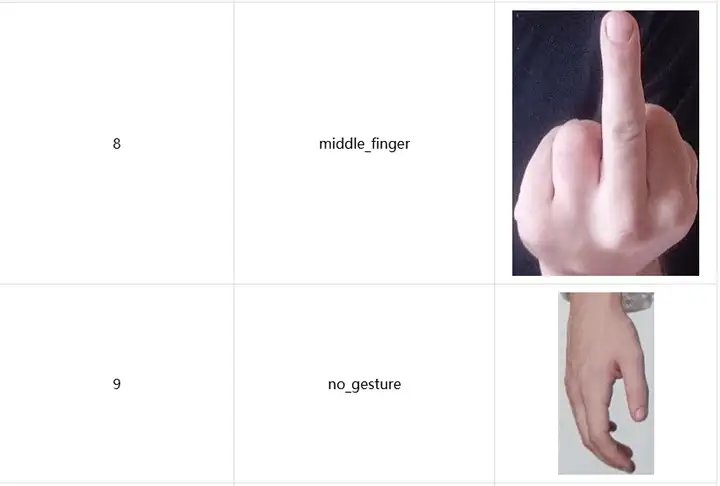

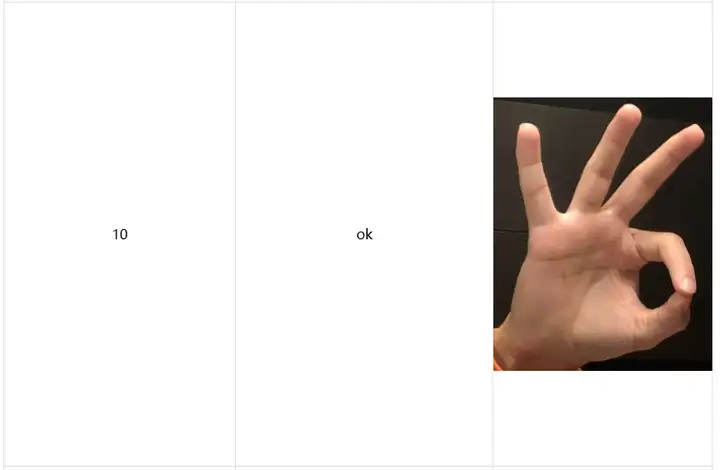

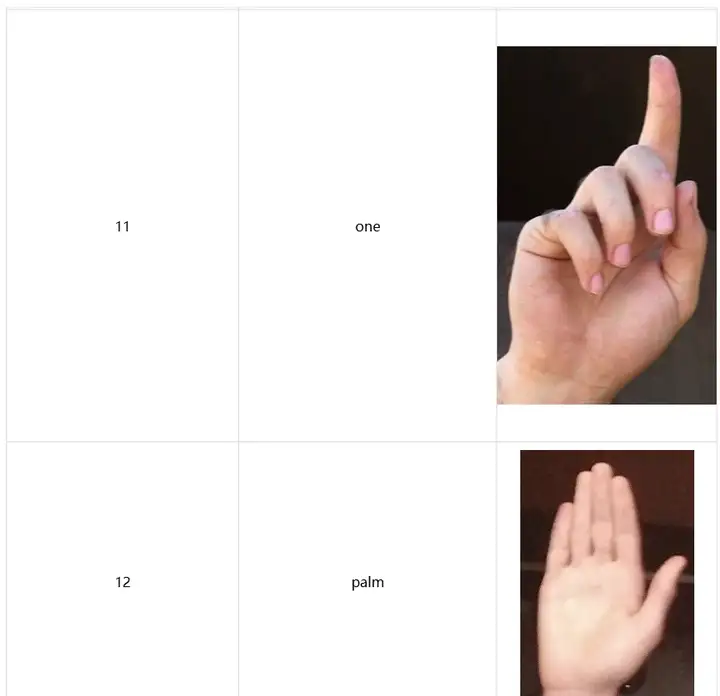

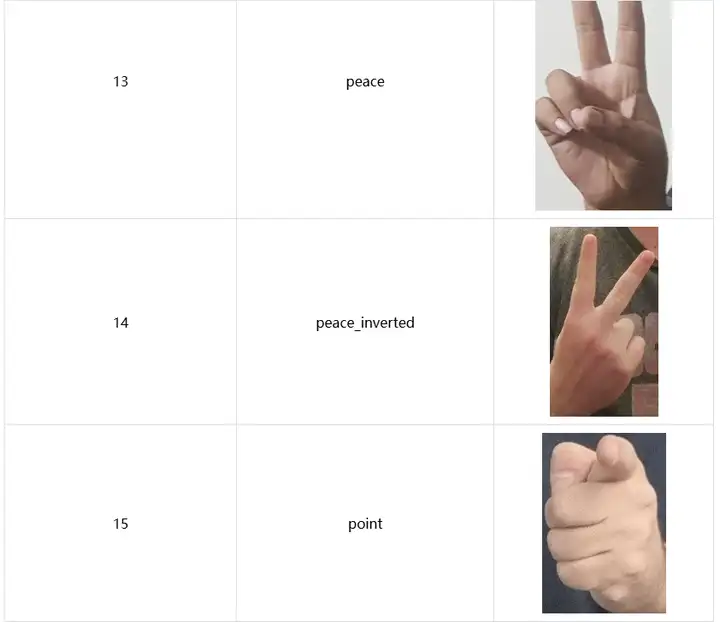

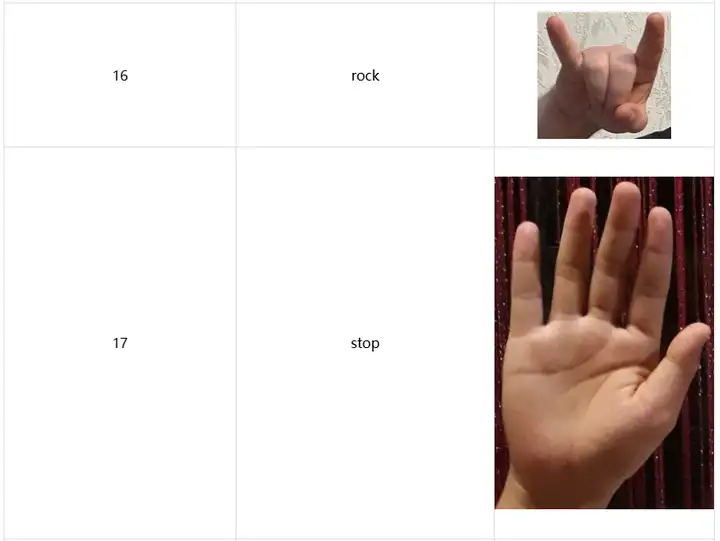

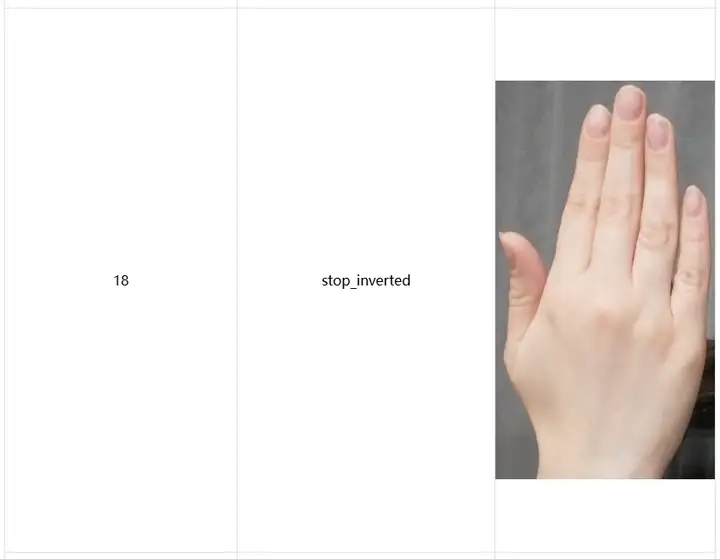

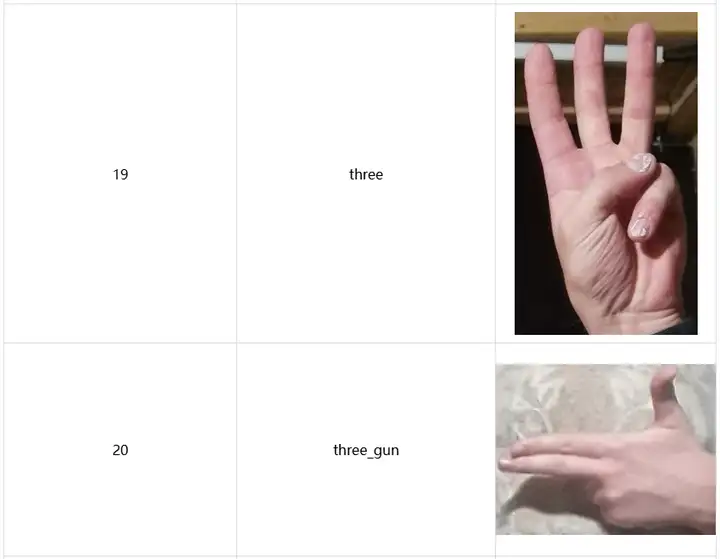

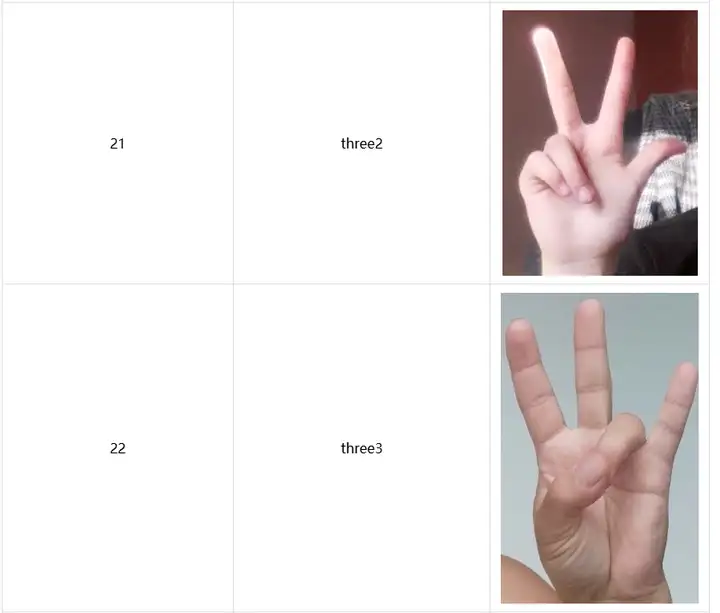

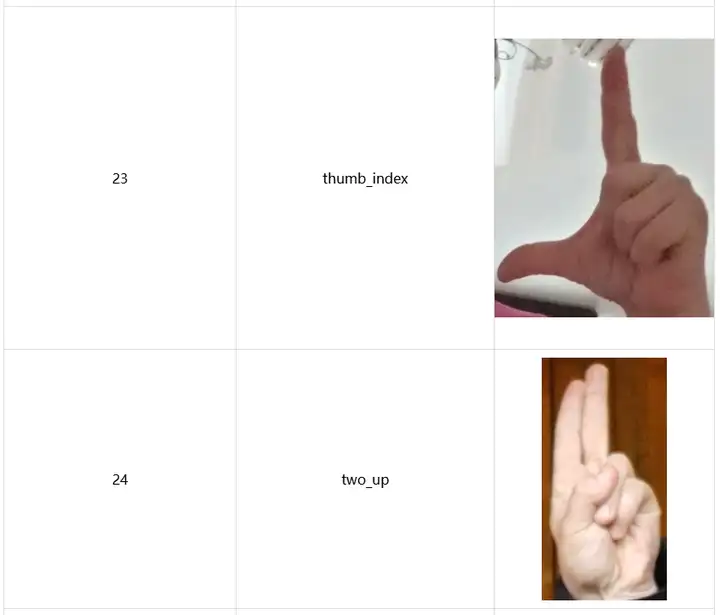

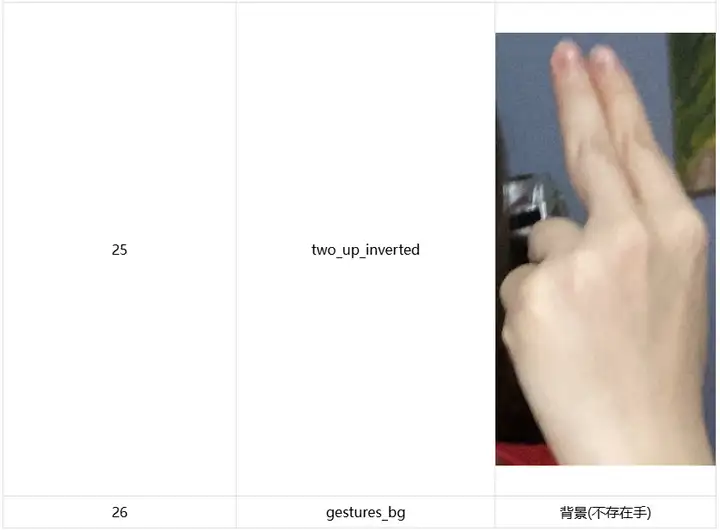

26种手势索引定义:

2. 快速上手

2.1 开发环境准备

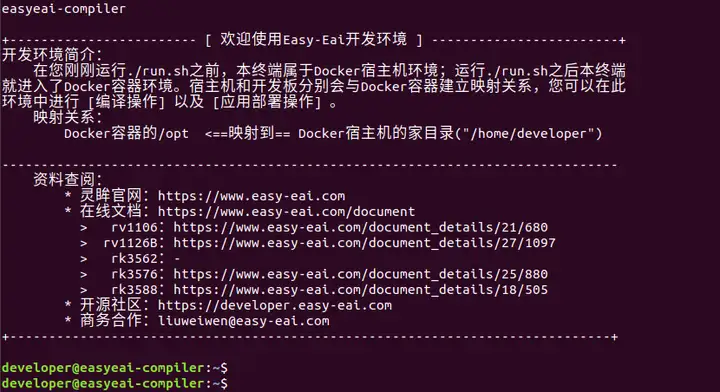

如果您初次阅读此文档,请阅读《入门指南/开发环境准备/Easy-Eai编译环境准备与更新》,并按照其相关的操作,进行编译环境的部署。

在PC端Ubuntu系统中执行run脚本,进入EASY-EAI编译环境,具体如下所示。

cd ~/develop_environment ./run.sh

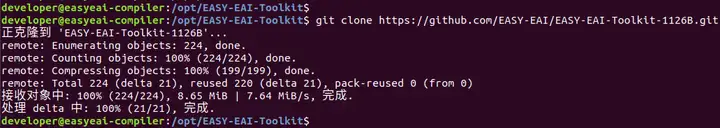

2.2 源码下载

在EASY-EAI编译环境下创建存放源码仓库的管理目录:

cd /opt mkdir EASY-EAI-Toolkit cd EASY-EAI-Toolkit

通过git工具,在管理目录内克隆远程仓库

git clone https://github.com/EASY-EAI/EASY-EAI-Toolkit-1126B.git

注:

* 此处可能会因网络原因造成卡顿,请耐心等待。

* 如果实在要在gitHub网页上下载,也要把整个仓库下载下来,不能单独下载本实例对应的目录。

2.3 模型部署

要完成算法Demo的执行,需要先下载手势识别算法模型。

百度网盘链接为:https://pan.baidu.com/s/1m2E1Sk_yi_-qMO5PLOXfdA?pwd=1234(提取码:1234 )。

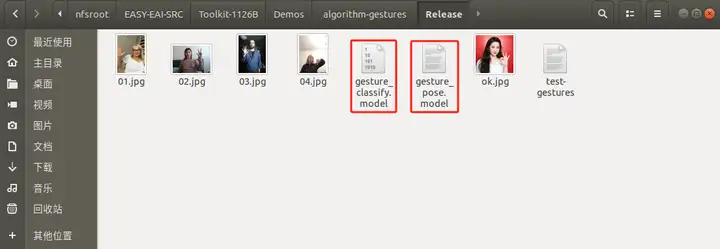

同时需要把下载的手势识别算法模型复制粘贴到Release/目录:

2.4 例程编译

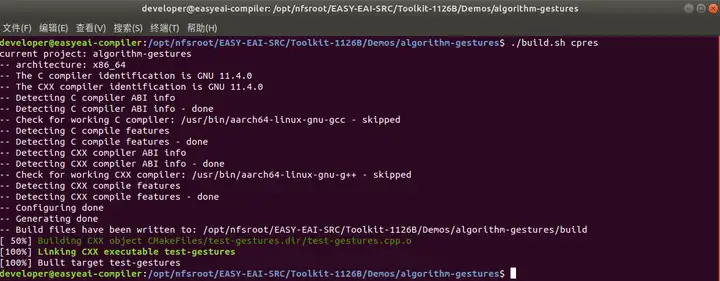

进入到对应的例程目录执行编译操作,具体命令如下所示:

cd EASY-EAI-Toolkit-1126B/Demos/algorithm-gestures/ ./build.sh cpres

注:

* 由于依赖库部署在板卡上,因此交叉编译过程中必须保持/mnt挂载。

* 若build.sh脚本带有cpres参数,则会把Release/目录下的所有资源都拷贝到开发板上。

2.5 例程运行及效果

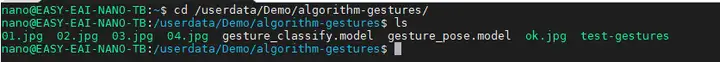

通过串口调试或ssh调试,进入板卡后台,定位到例程部署的位置,如下所示:

cd /userdata/Demo/algorithm-gestures/

运行例程命令如下所示:

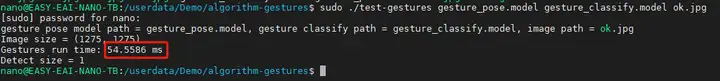

sudo ./test-gestures gesture_pose.model gesture_classify.model ok.jpg

在EASY-EAI编译环境可以取回测试图片:

cp /mnt/userdata/Demo/algorithm-gestures/result.jpg .

结果图片如下所示:

API的详细说明,以及API的调用(本例程源码),详细信息见下方说明。

3. 手势识别API说明

3.1 引用方式

为方便客户在本地工程中直接调用我们的EASY EAI API库,此处列出工程中需要链接的库以及头文件等,方便用户直接添加。

3.2 手势识别算法初始化函数

手势识别初始化函数原型如下所示。

int gestures_init(const char *p_gestures_path, const char *p_mobilenet_path, rknn_gestures_context_t &gestures, int cls_num);

具体介绍如下所示。

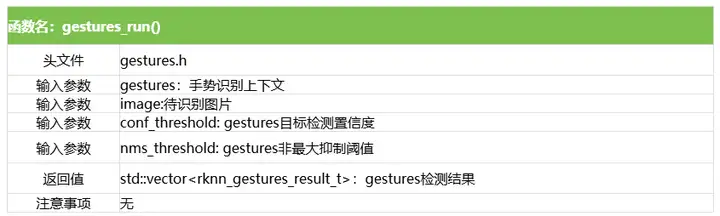

3.3 手势识别算法运行函数

手势识别运行函数gestures_run原型如下所示。

std::vector gestures_run(rknn_gestures_context_t &gestures, cv::Mat image, float conf_threshold, float nms_threshold);

具体介绍如下所示。

3.4 手势识别算法释放函数

手势识别释放函数原型如下所示。

int gestures_release(rknn_gestures_context_t &gestures);

具体介绍如下所示。

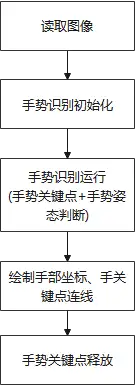

4. 手势识别算法例程

例程目录为Demos/algorithm-gestures/test-gestures.cpp,操作流程如下。

参考例程如下所示。

#include #include #include #include #include #include "gestures.h" /// 分类名称 char gpp_gestures[27][100] = { "00-call", "01-dislike", "02-fist", "03-four", "04-grabbing", "05-grip", "06-like", "07-little_finger", "08-middle_finger", "09-no_gesture", "10-ok", "11-one", "12-palm", "13-peace", "14-peace_inverted", "15-point", "16-rock", "17-stop", "18-stop_inverted", "19-three", "20-three_gun", "21-three2", "22-three3", "23-thumb_index", "24-two_up", "25-two_up_inverted", "26-gestures_bg" }; /// 绘制手势 cv::Mat draw_image(cv::Mat image, std::vector results) { long unsigned int i =0; for (i = 0; i < results.size(); i++) { cv::Rect rect(results[i].left, results[i].top, (results[i].right - results[i].left), (results[i].bottom - results[i].top)); cv::rectangle(image, rect, CV_RGB(255, 0, 0), 2); char p_text[128]; sprintf(p_text, "%s-%0.2f", gpp_gestures[results[i].gesture], results[i].score); cv::putText(image, p_text, cv::Point(rect.x, rect.y - 5), 1, 1.2, CV_RGB(255, 0, 0), 2); cv::Point pt0(results[i].keypoints[0][0], results[i].keypoints[0][1]); cv::circle(image, pt0, 2, CV_RGB(0, 255, 0), 3); for (int m = 0; m < 5; m++) { int idx = 4 * m + 1; cv::Point pt1(results[i].keypoints[idx][0], results[i].keypoints[idx][1]); cv::Point pt2(results[i].keypoints[idx + 1][0], results[i].keypoints[idx + 1][1]); cv::Point pt3(results[i].keypoints[idx + 2][0], results[i].keypoints[idx + 2][1]); cv::Point pt4(results[i].keypoints[idx + 3][0], results[i].keypoints[idx + 3][1]); cv::circle(image, pt1, 2, CV_RGB(0, 255, 0), 3); cv::circle(image, pt2, 2, CV_RGB(0, 255, 0), 3); cv::circle(image, pt3, 2, CV_RGB(0, 255, 0), 3); cv::circle(image, pt4, 2, CV_RGB(0, 255, 0), 3); cv::line(image, pt0, pt1, CV_RGB(255, 0, 0), 2); cv::line(image, pt1, pt2, CV_RGB(255, 0, 0), 2); cv::line(image, pt2, pt3, CV_RGB(255, 0, 0), 2); cv::line(image, pt3, pt4, CV_RGB(255, 0, 0), 2); } } return image; } /// 主函数 int main(int argc, char **argv) { if (argc != 4) { printf("%s \n", argv[0]); return -1; } const char *p_gesture_pose_path = argv[1]; const char *p_gesture_classify_path = argv[2]; const char *p_img_path = argv[3]; printf("gesture pose model path = %s, gesture classify path = %s, image path = %s\n", p_gesture_pose_path, p_gesture_classify_path, p_img_path); // 读取图片 cv::Mat image = cv::imread(p_img_path); if(image.empty()){ printf("Image is empty.\n"); return 0; } printf("Image size = (%d, %d)\n", image.rows, image.cols); // 手势识别初始化 int ret; rknn_gestures_context_t gestures; gestures_init(p_gesture_pose_path, p_gesture_classify_path, gestures, 1); // 手势识别函数 double start = static_cast(cv::getTickCount()); std::vector results = gestures_run(gestures, image, 0.35, 0.35); double end = static_cast(cv::getTickCount()); double runtime = (end - start) / cv::getTickFrequency() * 1000; std::cout << "Gestures run time: " << runtime << " ms" << std::endl; // 绘制结果 image = draw_image(image, results); cv::imwrite("result.jpg", image); printf("Detect size = %ld\n", results.size()); // 内存释放 ret = gestures_release(gestures); return ret; }

- 相关推荐

- 热点推荐

- 人工智能

- 开发板

- 瑞芯微

- EASY-EAI灵眸科技

- RV1126B

-

瑞芯微(EASY EAI)RV1126B 音频输入2025-12-18 2693

-

瑞芯微(EASY EAI)RV1126B PWM使用2026-01-06 8911

-

瑞芯微(EASY EAI)RV1126B 音频输出2026-04-01 8706

-

【EASY EAI Nano-TB(RV1126B)开发板试用】+初识篇2025-10-25 1043

-

【EASY EAI Nano-TB(RV1126B)开发板试用】+1、开箱上电2025-11-19 1320

-

【EASY EAI Nano-TB(RV1126B)开发板试用】介绍、系统安装2025-12-23 1079

-

RV1126系列选型指南:从RV1126到RV1126B,一文看懂升级差异2025-09-04 5445

-

【免费试用】EASY EAI Nano-TB(RV1126B)开发套件评测2025-09-23 1387

-

瑞芯微RV1126B特性概述2025-10-09 2389

-

替代升级实锤!实测RV1126B,CPU性能吊打RV11262025-12-11 2731

-

瑞芯微(EASY EAI)RV1126B 人员检测使用2026-01-11 3745

-

瑞芯微(EASY EAI)RV1126B 人体关键点识别2026-01-23 4150

-

瑞芯微(EASY EAI)RV1126B rknn-toolkit-lite2使用方法2026-04-22 1001

-

瑞芯微(EASY EAI)RV1126B yolov11训练部署教程2026-05-09 842

-

瑞芯微RV1126B 方案特性2026-05-11 1320

全部0条评论

快来发表一下你的评论吧 !