结合深度学习与最新Pytorch1.0来为你细致讲解

电子说

描述

近日,在 NeurIPS 2018 大会上,Facebook 官方宣布 PyTorch 1.0 正式版发布了。如何用Pytorch1.0搞深度学习?对很多小白学生是个问题。瑞士非盈利研究机构 Idiap Research Institute的研究员FRANÇOIS FLEURET开设了一门深度学习课程(2019年秋季),详细结合深度学习与最新Pytorch1.0来为你细致讲解,是学习Pytorch1.0深度学习不可多得的材料。

课程网址:

https://fleuret.org/ee559/

Francois Fleuret于2000年获得巴黎第六大学数学博士学位,2006年获得巴黎第十三大学数学博士学位。他是瑞士Idiap研究所计算机视觉和学习小组的负责人。在此之前,他曾在美国芝加哥大学、法国信息与自动化研究所(INRIA)和瑞士洛桑联邦理工学院(EPFL)任职。他是IEEE模式分析和机器智能交易的副主编,也是几个欧洲资助机构的专家。

深度学习课程概述

本课程的目标是提供深度机器学习的完整讲解。如何设计一个神经网络,如何训练它,以及有哪些现有技术专门处理非常大的网络结构。本课程旨在教授应用问题的深度学习方法所需的技能。

课程计划内容:

1. 什么是深度学习,张量介绍。

2. 基本机器学习,经验风险最小化,简单嵌入。

3. 线性可分性,多层感知器,反向传播。

4. 通用网络,autograd,批处理,卷积网络。

5. 初始化、优化和正则化。Dropout,激活归一化,跳过连接。

6. 计算机视觉的深层模型。

7. 深入模型分析。

8. 自编码器,嵌入式和生成模型。

9. 循环模型和自然语言处理。

10. pytorch张量,深度学习模块,和内部构件。

深度学习课程导读

绪论

1.1 从神经网络到深度学习,21页slides

1.2 当前成功应用的实例 22页slides

1.3 正在发生什么? (13页slides)

1.4 张量基础和线性回归 12 页slides

1.5 高维张量. 15页slides

1.6 张量内部 5页slides

2. 机器学习基础

2.1 损失函数与风险. 15页slides

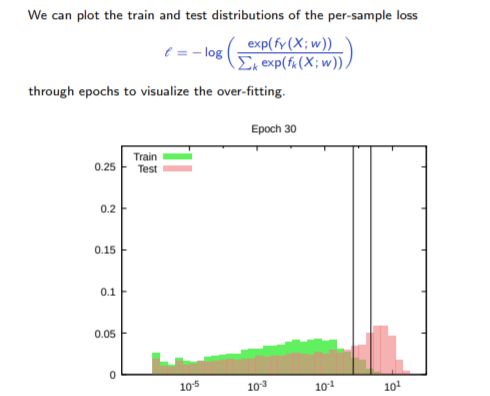

2.2 过拟合与欠拟合. 24页slides

2.3 方差-偏差困境 10页slides

2.4 合适评价方法 6页slides

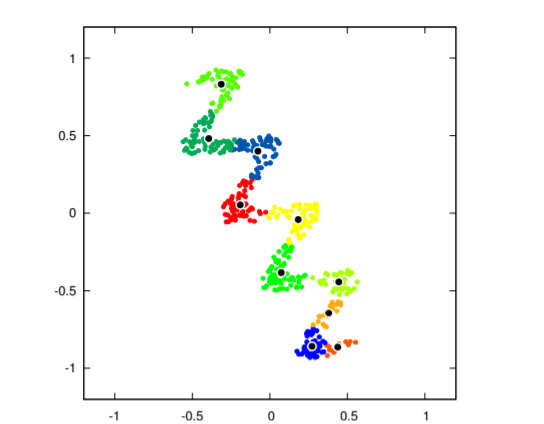

2.5 基本聚类与嵌入方法19页slides

3. 多层感知器和反向传播

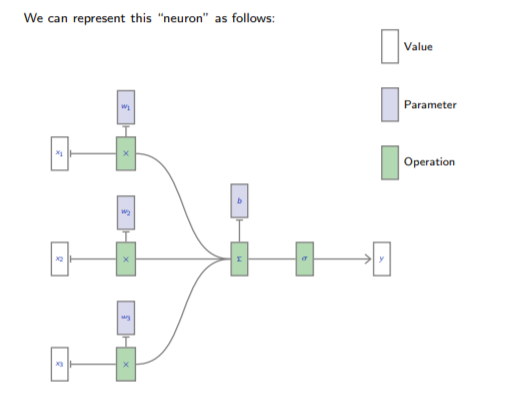

3.1 感知器。(幻灯片,讲义- 16张)

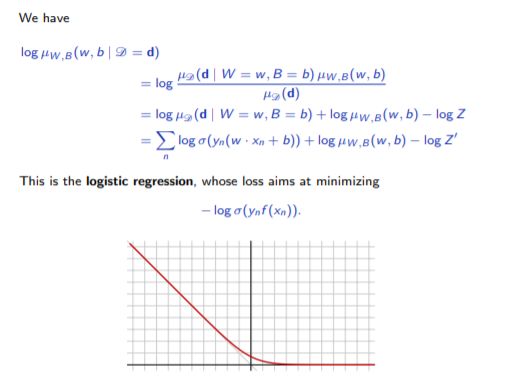

3.2 线性分类器的概率视图。(幻灯片,讲义- 8张)

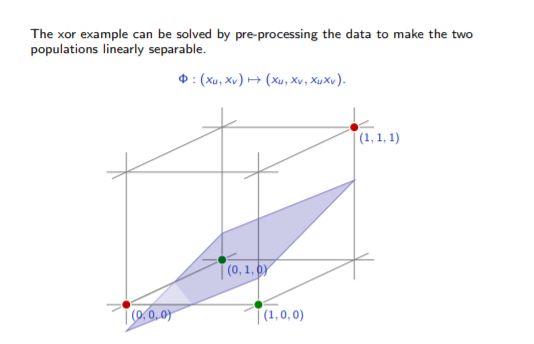

3.3 线性可分性与特征设计。(幻灯片,讲义- 10张)

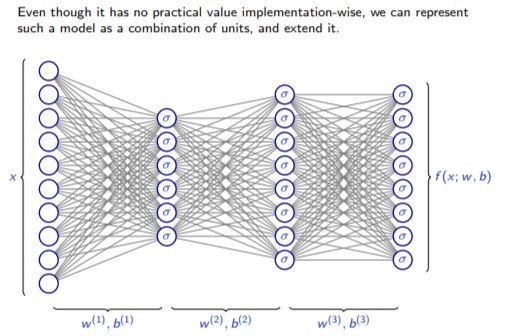

3.4 多层感知器。(幻灯片,讲义- 10张)

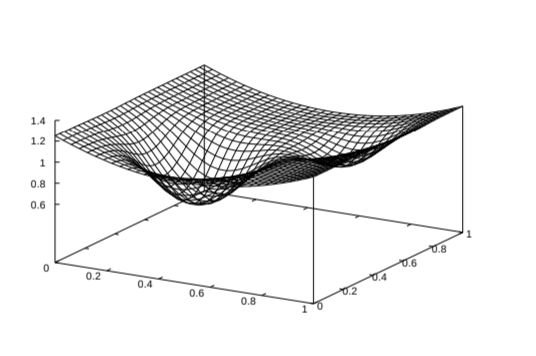

3.5 梯度下降法。(幻灯片,讲义- 13张)

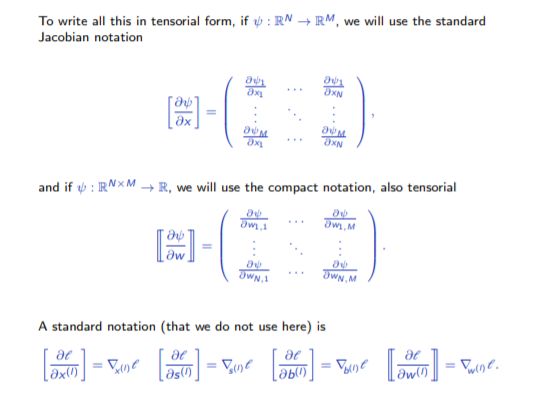

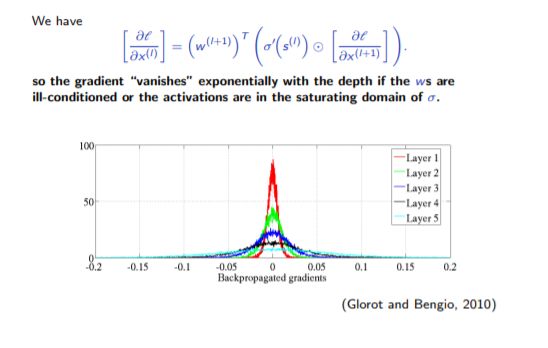

3.6 反向传播。(幻灯片,讲义- 11张)

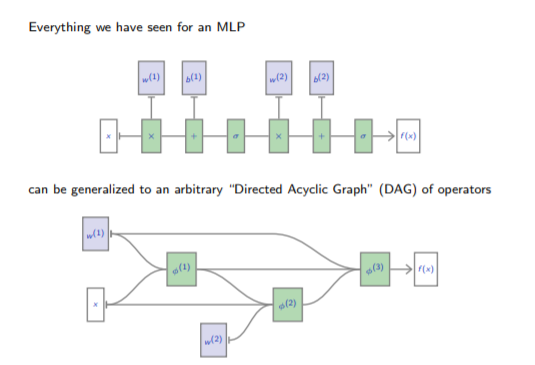

4. 操作符、autograd和卷积层的图操作

4.1 DAG网络。(幻灯片,讲义- 11张)

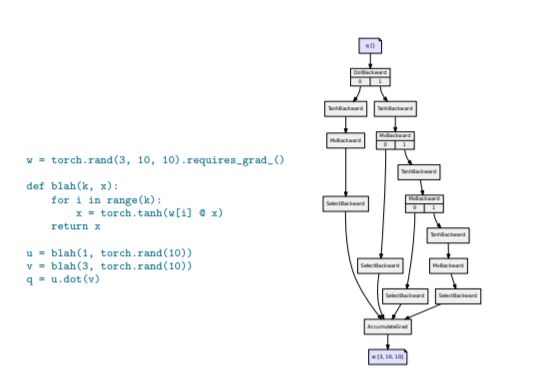

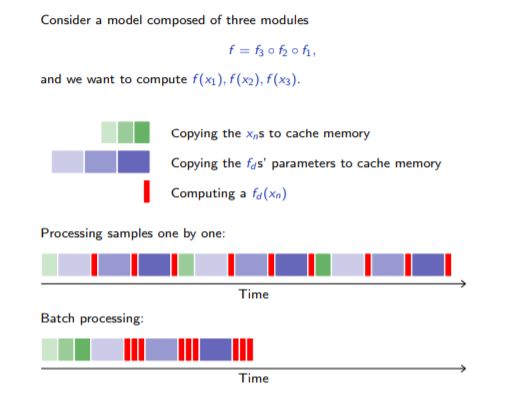

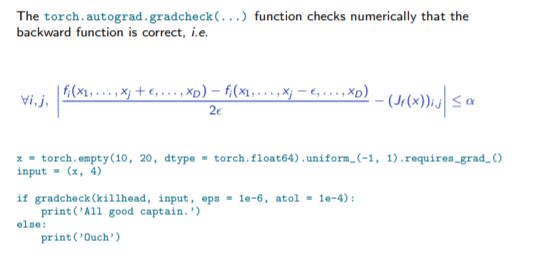

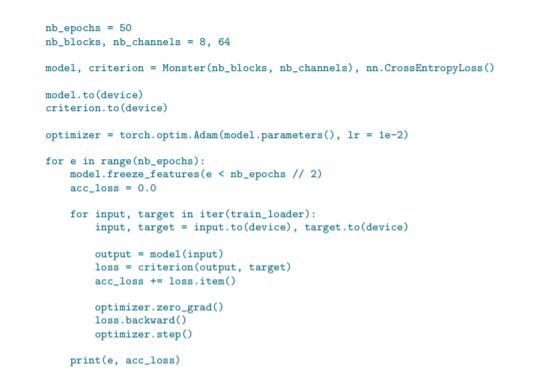

4.2 Autograd。(幻灯片,讲义- 19张)

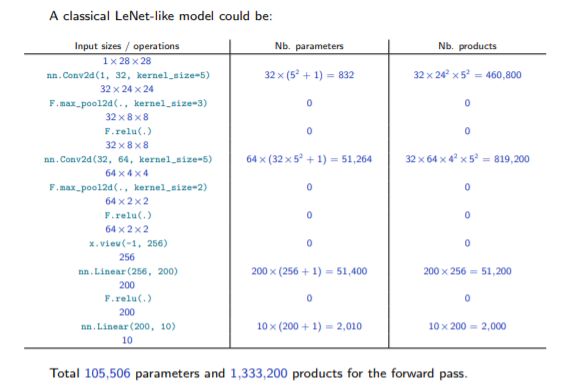

4.3 PyTorch模块和批处理。(幻灯片,讲义- 14张)

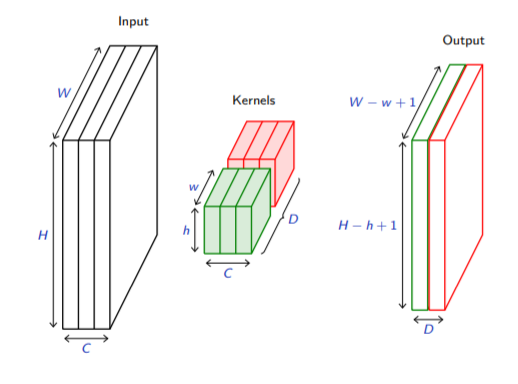

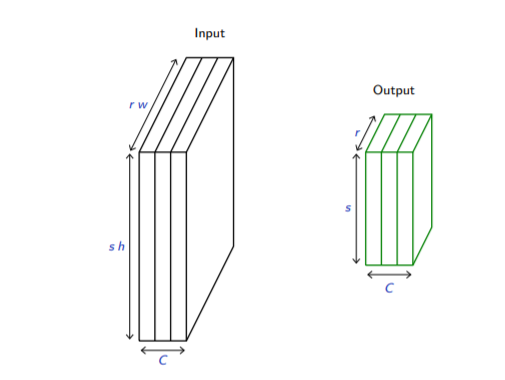

4.4 卷积。(幻灯片,讲义- 23张)

4.5 池化(幻灯片,讲义- 7张)

4.6 编写一个PyTorch模块。(幻灯片,讲义- 10张)

5.1 交叉熵损失。(幻灯片,讲义- 9张)

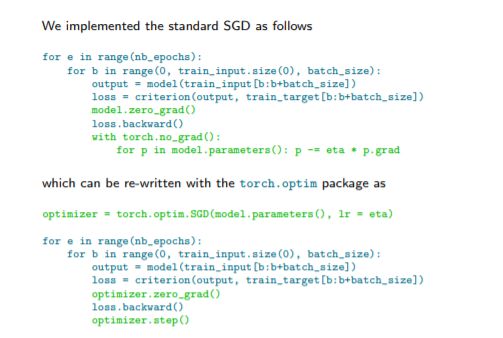

5.3 PyTorch优化。(幻灯片,讲义- 8张)

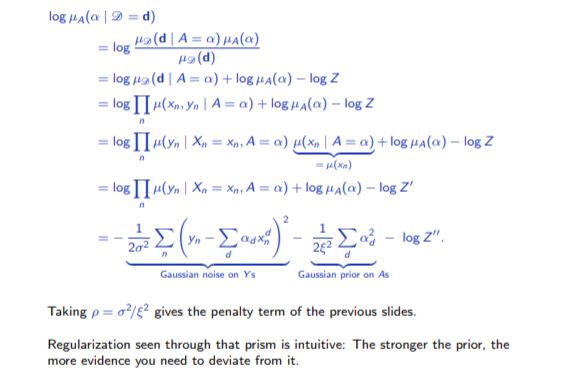

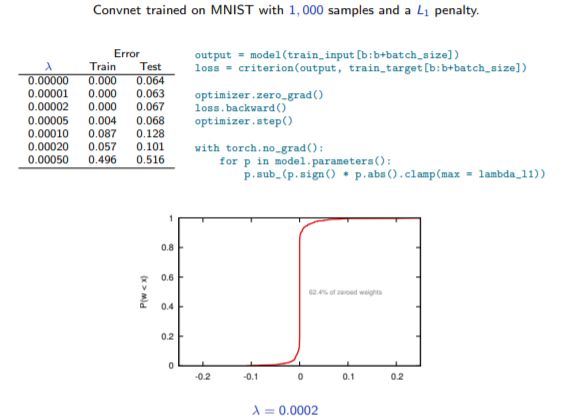

5.3 L1和L2 惩罚项。(幻灯片,讲义- 10张)

5.4 参数初始化。(幻灯片,讲义- 22张)

5.5 网络架构选择和训练协议。(幻灯片,讲义- 9张)

5.6 写一个autograd函数。(幻灯片,讲义- 7张)

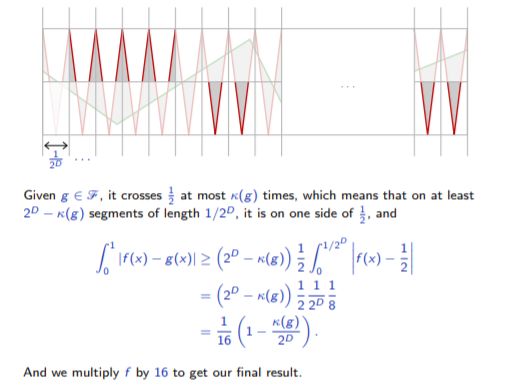

6.1 深度的好处。(幻灯片,讲义- 9张)

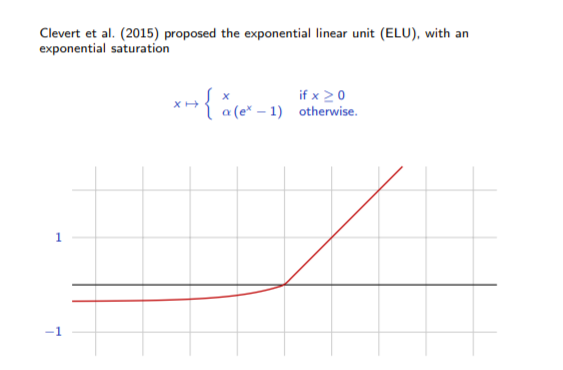

6.2 修正器。(幻灯片,讲义- 7张)

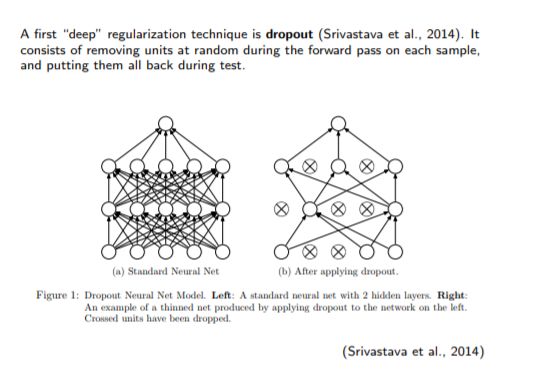

6.3 Dropout (幻灯片,讲义- 12张)

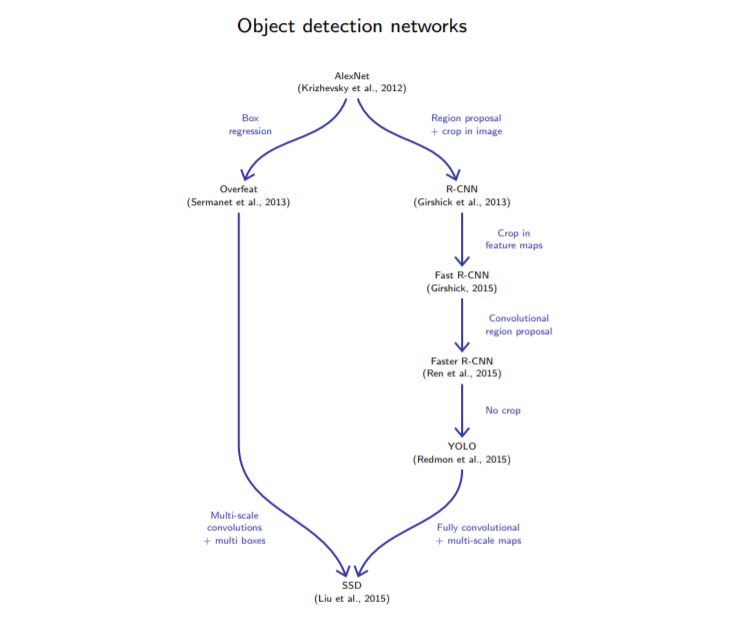

7.1计算机视觉任务。(幻灯片,讲义- 15张)

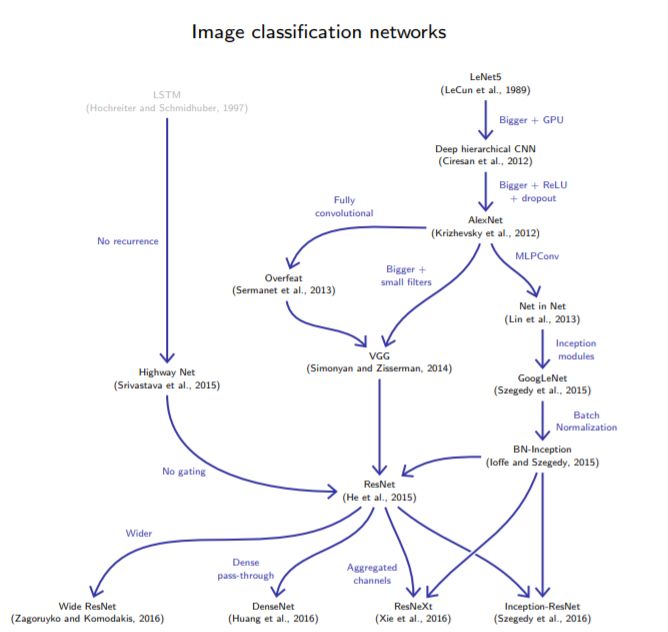

7.2 用于图像分类的网络。(幻灯片,讲义- 36张)

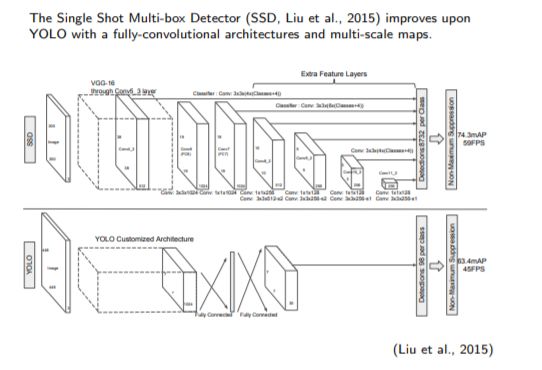

7.3 用于目标检测的网络。(幻灯片,讲义- 15张)

7.4 用于语义分割的网络。(幻灯片,讲义- 8张)

7.5 DataLoader和神经。(幻灯片,讲义- 13张)

8. 关键技巧方法处理

8.1 看参数。(幻灯片,讲义- 11张)

8.2 激活。(幻灯片,讲义- 21张)

8.3 可视化输入中的处理。(幻灯片,讲义- 26张)

8.4 优化输入。(幻灯片,讲义- 25张)

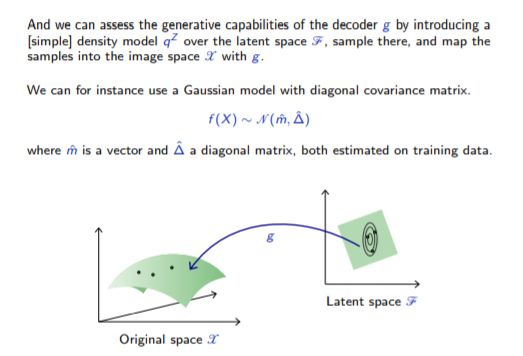

9. 自编码器和生成模型。

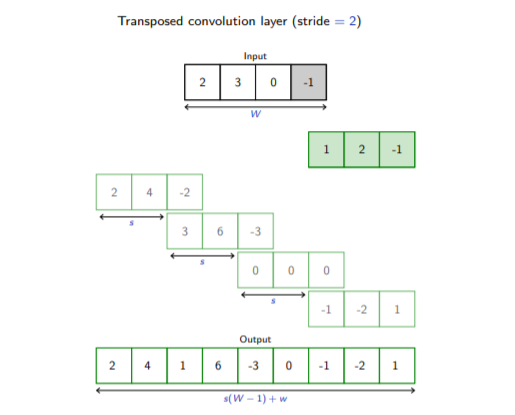

9.1 转置运算。(幻灯片,讲义- 14张)

9.2 Autoencoders。(幻灯片,讲义- 20张)

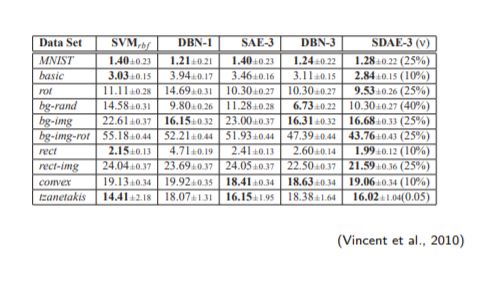

9.3 去噪和变分自编码器。(幻灯片,讲义- 24张)

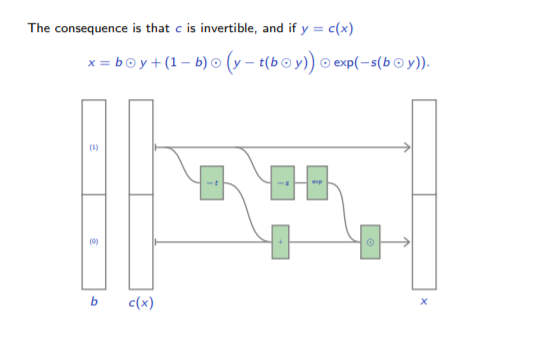

9.4 Non-volume保存网络。(幻灯片,讲义- 24张)

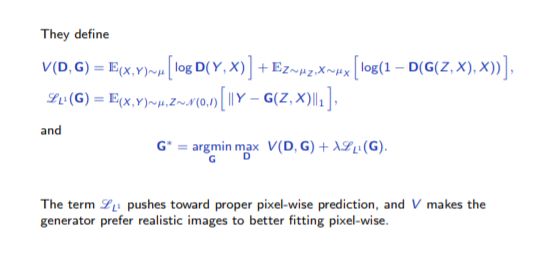

10. 生成对抗模型。

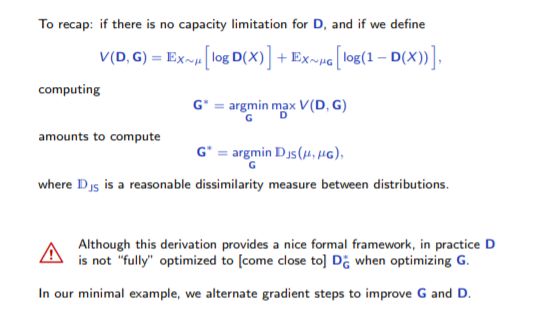

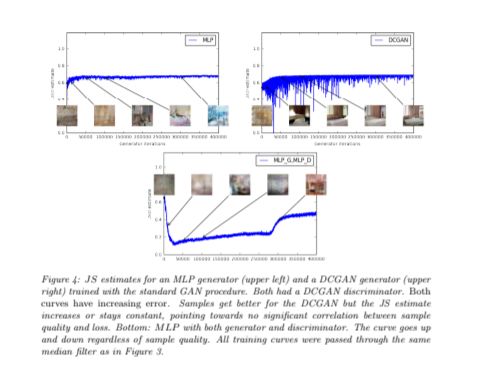

10.1 生成对抗的网络。(幻灯片,讲义- 29张)

10.2 Wasserstein GAN。(幻灯片,讲义- 16张)

10.3 条件GAN和图像转换。(幻灯片,讲义- 27张)

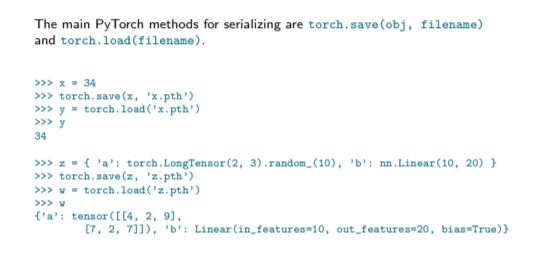

10.4 模型持久性和检查点。(幻灯片,讲义- 9张)

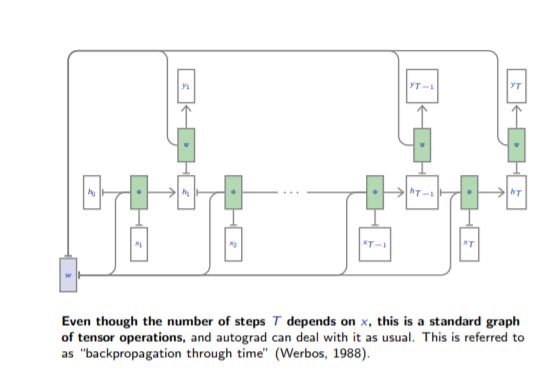

11 循环模型与NLP

11.1 循环神经网络 (slides, handout – 23 slides)

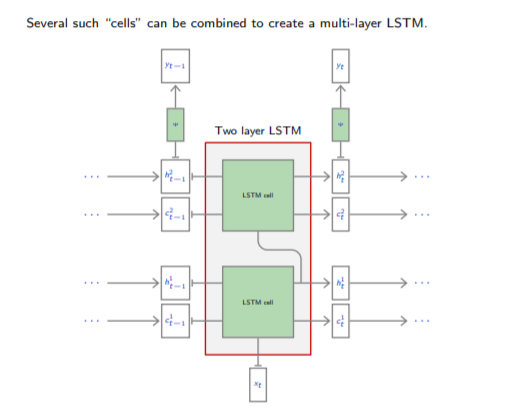

11.2 LSTM 和 GRU. (slides, handout – 17 slides)

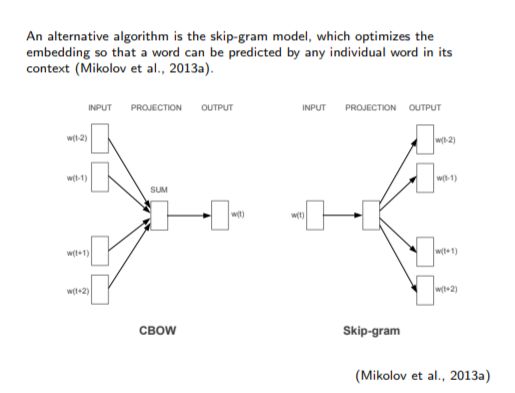

11.3 Word embeddings 与translation. (slides, handout – 31 slides)

更多阅读:

5. 初始化和优化。

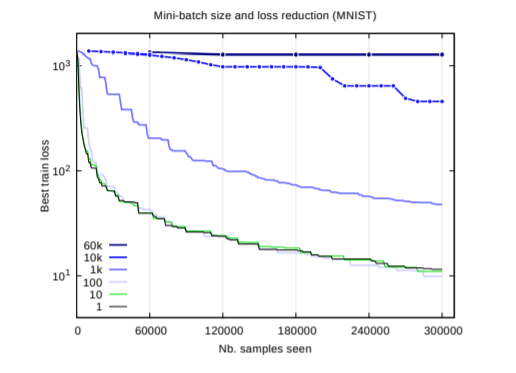

5.2 随机梯度下降法。(幻灯片,讲义- 17张)

6. 搞更深

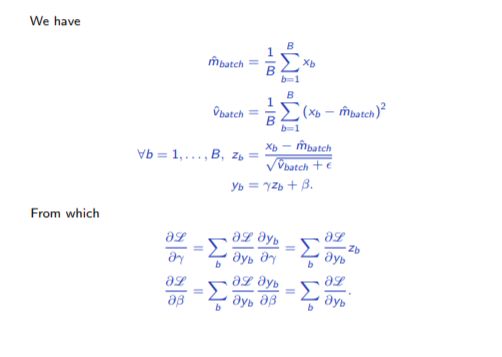

6.4 批处理归一化。(幻灯片,讲义- 15张)

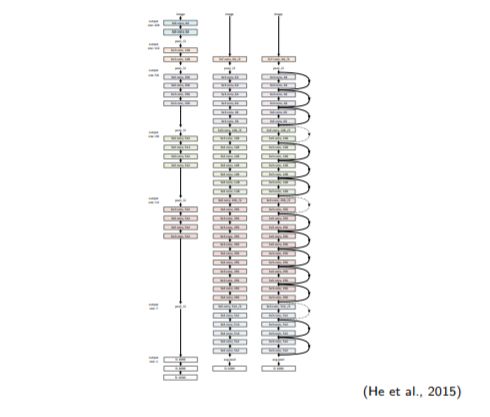

6.5 残差网络。(幻灯片,讲义- 21张)

6.6 使用gpu。(幻灯片,讲义- 17张)

-

Pytorch深度学习训练的方法2024-10-28 1330

-

PyTorch深度学习开发环境搭建指南2024-07-16 4193

-

TensorFlow与PyTorch深度学习框架的比较与选择2024-07-02 2834

-

深度学习框架pytorch入门与实践2023-08-17 2580

-

PyTorch教程12.1之优化和深度学习2023-06-05 708

-

通过Cortex来非常方便的部署PyTorch模型2022-11-01 2408

-

基于PyTorch的深度学习入门教程之PyTorch的安装和配置2021-02-16 3335

-

为什么学习深度学习需要使用PyTorch和TensorFlow框架2019-09-14 4215

-

PyTorch官网教程PyTorch深度学习:60分钟快速入门中文翻译版2019-01-13 11052

-

Facebook宣布发布深度学习框架 PyTorch 1.0开发者预览版2018-10-08 3819

-

深度学习是什么?了解深度学习难吗?让你快速了解深度学习的视频讲解2018-08-23 1447

-

Facebook致力AI 开源PyTorch1.0 AI框架2018-06-18 3776

全部0条评论

快来发表一下你的评论吧 !