AI识别亲吻动作,也搞起浪漫来

电子说

描述

7月6日,这可能是一年中最适合亲吻的日子——国际接吻日(International Kissing Day)。

这个节日最早起源于英国。1991年这个节日得到了联合国的承认,也希望让更多人知道,亲吻的美好,这也是人类表达爱意最自然的一种方式。

那么,人工智能可以通过训练了解亲吻吗?

来自Netflix的一位高级数据科学家就对“kiss”镜头情有独钟,并且通过上百部电影接吻情节的定位,成功训练出了可以准确识别电影亲吻桥段的AI模型——模型的独创性在于可以区别亲吻与性行为。

大千世界,无所不能,AI也能检测到"kiss"?

让AI区别kiss和sex

作为爱情片的代表情节,“亲吻”一直是很多观众最爱反复观看的镜头。不管是《人鬼情未了》中Swayze和Demi Moore的经典接吻桥段,还是《泰坦尼克号》中Rose和Jack的临别一吻,都造就了经典中的经典。

而在电影观看过程中,寻找kiss镜头,就成为了不少娱乐视频场景下的一个真实需求。

这项基于人工智能识别接吻的研究由出自Netflix高级数据科学家Amir Ziai之手——此时他正在斯坦福大学攻读人工智能研究生学位。

Ziai在上世纪好莱坞电影中挑选了100部有代表性的作品,并为电影片段手动标注“亲吻”或“非亲吻”标签,用静态画面和声音片段来训练深度学习算法,以实现对亲吻场景的画面和声音的识别。

为了避免任何人得到错误的印象,目前还不能确定亲吻识别算法能否用于***场景。Ziai说到,“在我的训练集中,我尽量避免出现***场景,这样就能确保我的模型不会混淆接吻和***。”

Ziai目前的雇主Netflix并没有参与到斯坦福大学的这个项目上,但该项目在arXiv中有详细记载;另外,即使Ziai还没去调研这项研究在Netflix上的应用,但是不难想象,Netflix或其他公司(如YouTube,Facebook,Instagram和TikTok等处理大量流媒体或存储视频的公司)可能会对这一技术的商业应用场景感兴趣。

该图是1990年的电影《人鬼情未了》中Swayze和Demi Moore的经典接吻桥段,数据科学家便是用了近百部类似的电影桥段来训练AI模型识别亲吻的行为。

感兴趣的读者可以阅读论文原文,附上地址:

https://arxiv.org/pdf/1906.01843.pdf

“双管齐下”:不仅视频识别,还有kiss的音频识别

应用于接吻场景视觉识别最成功的深度学习模型是ResNet-18,这是一种图像分类算法,且该算法经来自ImageNet数据库超过一百万张图像的预训练;而为了识别接吻场景的声音,研究人员采用了名为VGGish的深度学习模型,通过每个以秒分段的场景的后960毫秒音频训练。这种双管齐下对接吻的图像和音频同时处理的AI方法使得训练出的模型获得了惊人的F1分(算法精度和准度的加权平均值,度量模型的一种指标)——0.95。

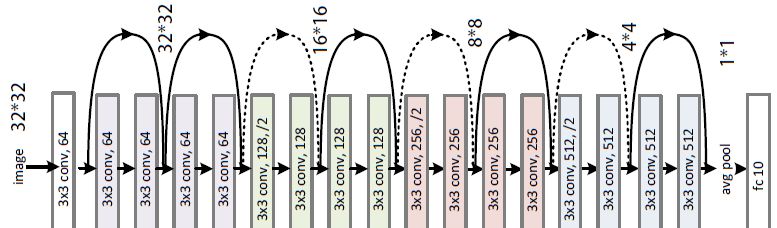

ResNet-18模型结构图

在模型结构中,采用"shortcut connection”方式,也就是上图中的弧线来减少卷积网络传播过程中的计算和参数量,感兴趣的读者可以研究下,VGGish是是产生音频数据集的工具,一般用于音频分类。

github网址如下:

https://github.com/tensorflow/models/tree/master/research/audioset

不过在面对电影场景中一些棘手的片段或某些拍摄机视角时,该模型还是略显吃力。例如,远景或广角的接吻镜头会使算法产生混淆,因为此类视频片段中包含了太多背景画面。此外,一些快节奏的视频片段和不同时包含两个演员的镜头对模型来讲也都是极大的挑战。

电影《Titanic》中Jack和Rose在邮轮甲板上拥吻图片

深度学习是一个“黑盒子”,我们很难弄清楚深度学习模型实现预测时所使用的的具体数据模式。为了尝试理解AI的逻辑,人们通常采用的一种方法是使用显著地形图来可视化分析过程中受到AI关注最多的数据。在好莱坞影片识别接吻场景的项目中,深度学习模型似乎更加关注与演员面部相关的图像像素点。

Ziai表示,即使是在少量有限的实验中也可以看出,人工智能更依赖视觉特征而不是音频特征来识别接吻场景。他发现“精心挑选的数据集”对于训练接吻检测系统有很大帮助,这类数据可以让该系统利用更多的上下文信息来检测接吻,而不仅仅是通过静态图像。

AI“kiss”之原理

AI模型是如何习得这种能力呢?

和初吻尚在的人类学习基本亲吻知识的途径一样,AI模型基于已经成熟的深度学习算法,观看各式各样的好莱坞明星上演的浪漫拥吻片段,通过这种大量的训练来识别影片中人物的面部表情和定位嘴唇,数据科学家说明了AI系统如何能够更深入地了解最亲密的人类活动的原理。

让AI识别kiss有什么用?

早在2019年4月,谷歌宣布其智能手机Pixel已更新其Photobooth功能,这项功能可以在你面部表情发生变化的时候自动拍照,比如说微笑、亲吻、嘟嘴、伸舌头等等,该功能可是使智能手机从手机拍摄的视频中识别出接吻画面。

具体来说,当你按下Photobooth功能的拍摄按键之后,手机的AI就会自动分析你的脸部表情。根据不同状态,手机会自动判定「最佳时刻」,并将这一刻记录下来。同样,Ziai研发的应用端视频接吻识别技术使我们看到了视频内容自动分类,用户个性化视频推荐,甚至视频在线内容审核的未来。

Pixel手机Photobooth功能拍摄的静态图片

OpenAI的策略和传播主管Jack Clark在他的文章《Import AI newsletter》中重点强调了这项研究的意义:“现代计算机视觉技术已经使得开发特定的'感知和响应类'软件变得相当容易,诸如识别定性或非结构化的东西,识别电影中的接吻场景就是一个极佳的例子,但此类AI对个人软件的应用能力明显被低估。”

AI“kiss”之未来

好莱坞影片数据集和计算资源由斯坦福大学计算机科学助理教授Kayvon Fatahalian的实验室提供。

目前,这个用100部好莱坞影片(如《安娜·卡列尼娜》(1935),《人鬼情未了》(1990)和《007:大战皇家赌场》(2006)等)训练的AI模型在面对更大规模的影片时性能尚不清楚。但Ziai表示,在经超过80个影片进行训练后,该模型只看到了“边际改善”。

另一个值得关注的问题是这种AI模型在检测来自社交媒体的不同类型接吻场景视频时否能达到相似的准确度。这是个极大的挑战,可能需要模型对更多的视频数据集进行额外训练,而且训练集中不能仅包含那些出现在电影银幕上诸如Patrick Swayze和Demi Moore的好莱坞明星。尽管如此,从一些非常初步的测试中能看出,这种基于AI的接吻测技术会有很好的的应用前景。

“未来研究将尽量使用更多样化的数据集,以确保模型不会对于某种类型的电影过拟合,”Ziai说道,“不过有趣的是,该模型在我所选的YouTube视频上性能表现得相当好。”

-

微软HoloLens正研发AI芯片 可识别语音和图像2017-07-31 3099

-

MPU6050和HMC5883L结合做动作识别有什么其他动作?2019-05-13 2317

-

怎么通过动作识别来进行正常控制的MP3?2019-10-11 1914

-

MCU也需要AI吗2021-11-03 1874

-

【开发教程17】AI语音人脸识别(会议记录仪-人脸打卡机)-AI人脸注册认证与识别2022-06-15 7093

-

【CC3200AI实验教程11】疯壳·AI语音人脸识别-AI语音系统架构2022-08-30 25319

-

【CC3200AI实验教程17】疯壳·AI语音人脸识别-AI人脸注册认证与识别2022-09-01 29189

-

浪漫自拍不服来战 飞屋环游大片你自己也能DIY2017-09-22 777

-

基于视频深度学习的时空双流人物动作识别模型2018-04-17 1906

-

隔空亲吻的黑科技 通过压力传感器来实现2018-08-24 197

-

视频动作识别是如何利用AI来实现的2020-03-07 12378

-

识别文字的AI也能发现新冠病毒变异2021-03-02 1404

-

深度学习中动作识别网络学习2021-06-25 3431

-

采用预训练的动作识别模型快速跟踪AI应用程序的开发2022-04-08 3765

-

蔚来AI底盘新识别颠簸点超3100万个2024-04-01 934

全部0条评论

快来发表一下你的评论吧 !