语音识别有哪些算法

好的,语音识别算法的核心目标是将连续的语音信号转换成对应的文字序列。随着技术的发展,主要的算法经历了从传统方法到深度学习方法的演变。以下是一些主要的语音识别算法分类和代表技术:

一、 传统方法(统计方法 + 模式识别)

这些是深度学习兴起之前的主流,通常需要分模块(声学模型、语言模型、发音词典) 和多阶段训练。

-

基于隐马尔可夫模型的声学模型 (HMM - Hidden Markov Model):

- 核心思想: 将语音信号建模为一个隐含状态序列(通常对应音素或子词单元)生成可观测声学特征的过程。每个状态有自己的输出概率分布(描述该状态下生成哪些特征的概率)。

- 关键组件:

- 状态转移概率: 状态跳转到另一个状态的概率。

- 观测概率: 在某个状态下,观测到特定声学特征的概率。通常用混合高斯模型建模。

- 解码过程: 使用维特比算法在 HMM 状态网格上搜索最优路径,该路径对应的状态序列就代表了最可能的识别结果(需结合语言模型)。

-

高斯混合模型-HMM (GMM-HMM):

- 描述: 这是在 HMM 框架下最经典的声学建模方法。它使用高斯混合模型来建模每个 HMM 状态的观测概率分布。

- 过程:

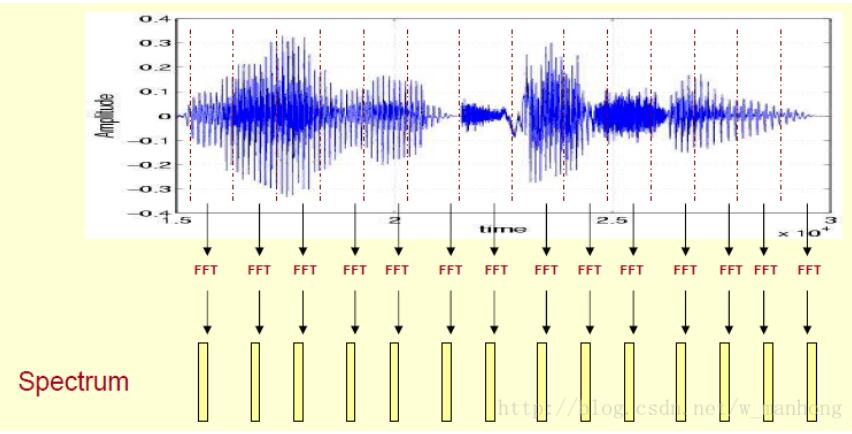

- 将语音信号分割成短帧(如每 10ms 一帧)。

- 对每帧提取声学特征,常用MFCC (梅尔频率倒谱系数) 或Filterbank。

- 用 GMM 建模每个 HMM 状态的声学特征分布。

- 结合发音词典和语言模型进行解码识别。

- 地位: 在深度神经网络兴起前是绝对主流,现在已基本被取代。

-

动态时间规整 (DTW - Dynamic Time Warping):

- 核心思想: 主要用于小词汇量、孤立词识别。它计算一个测试语音模板与一组参考模板之间的时间规整距离,找到距离最小的参考模板作为识别结果。它可以克服语速变化带来的时间尺度不一致问题。

- 原理: 找到一种最优的“弯折”路径(时间对齐方式),使得测试模板和参考模板的对应帧之间的累计距离最小。

- 优点: 简单直观,适用于资源受限或固定命令的场景。

- 缺点: 难以扩展到大词汇量连续语音识别;需要存储参考模板;无法有效建模上下文依赖。

二、 深度学习方法

深度神经网络极大地提升了语音识别的性能,已成为当前的主流和未来方向。其核心优势在于强大的特征学习和模式识别能力。

-

基于深度神经网络的声学模型 (DNNs for AM):

- 混合方法 (DNN-HMM / DNN-HMM Hybrid):

- 核心思想: 保留 HMM 的框架用于状态建模和解码,但用 深度神经网络取代 GMM 来建模 HMM 状态的观测概率(后验概率)。输入是声学特征(或其上下文),输出通常是 上下文相关的音素(Senones)的后验概率。

- 过程:

特征提取->DNN (输入帧特征,输出每个可能状态的分数/后验概率)->HMM(状态转移概率建模和解码)-> 输出词序列(结合语言模型)。 - 优势: DNN 比 GMM 更擅长建模复杂的非线性声学模式,显著提升了识别准确率。

- 代表性结构 (作为声学模型的一部分):

- 深度前馈神经网络: 早期用于替代 GMM 的基本深度网络。

- 卷积神经网络 (CNN):

- 擅长捕捉局部特征(如频谱图上的局部相关性,类似人的听觉滤波器组)。

- 常用于对输入频谱图或Filterbank特征进行初始的特征提取和处理。如 TDNN、CNN-HMM。

- 递归神经网络 (RNN) / 长短期记忆网络 (LSTM) / 门控循环单元 (GRU):

- 核心优势: 处理序列数据的时序依赖性至关重要。语音是典型的时序信号。

- LSTM/GRU: 解决了基本 RNN 的长距离依赖训练问题(梯度消失/爆炸),能更有效地建模语音信号的长期上下文。

- 应用: 常用于DNN-HMM混合系统的声学模型主体(输入帧序列,输出帧级别的状态后验概率)。双向LSTM(Bi-LSTM)能同时利用过去和未来上下文信息。

- 混合方法 (DNN-HMM / DNN-HMM Hybrid):

-

基于注意力的序列到序列模型 (Attention-based Seq2Seq):

- 核心思想: 端到端模型的代表之一。模型直接学习从输入声学特征序列到输出字符/字/词序列的映射,无需显式对齐或强制依赖于HMM和发音词典。

- 核心组件:

- 编码器 (Encoder): 通常是一个RNN (LSTM/GRU) 或 Transformer 结构,将输入特征序列(X)编码成一个高层表示序列(Context Vector Sequence)。

- 解码器 (Decoder): 另一个 RNN (LSTM/GRU),在每一步生成输出词时,动态地从编码器输出的序列中选择性地关注(通过注意力机制,Attention)与之最相关的部分信息。

- 过程: Encoder

编码语音特征序列->Decoder + Attention逐步生成目标文本序列。 - 优势: 简化流程,无需强制帧对齐;模型更灵活;可有效利用全局上下文。

-

基于转换器的模型 (Transformer):

- 核心思想: 源自自然语言处理领域,通过自注意力机制 (Self-Attention) 取代 RNN/LSTM 进行序列建模。它更擅长捕捉序列内部的长距离依赖关系,并且计算效率更高(易于并行)。

- 结构: 核心是 编码器-解码器 架构,但内部使用基于 Self-Attention 的 Transformer 块堆叠而成。

- 在ASR中的应用:

- 可用作 Attention-based Seq2Seq 模型的 Encoder(替代RNN)或 Encoder-Decoder(完全替代RNN)。

- 自监督预训练模型: 大规模无标签语音上进行预训练(如 Wav2Vec, HuBERT),然后在下游少量有标签数据上微调进行语音识别。这是当前最前沿、性能最好的方向之一。这些模型(如 Whisper)通常基于 Transformer Encoder 结构。

-

连接时序分类 (CTC - Connectionist Temporal Classification):

- 核心思想: 端到端模型的代表之一。在RNN的输出端(或其他模型的输出序列)引入一个特殊的

<blank>字符。CTC 允许模型在输入序列长于输出序列(即一个输出符号对应多个输入帧)的情况下进行训练,而无需精确的帧级对齐信息。 - 解码: 在预测时,CTC模型输出一串带有可能重复符号和

<blank>的序列。最后通过简单的合并重复字符并去除<blank>得到最终的目标序列。需要外部语言模型参与解码。 - 优势: 可以学习输入(声学帧)到输出(标签序列)的映射,而不用知道具体的对齐信息。常用于配合RNN/LSTM。

- 核心思想: 端到端模型的代表之一。在RNN的输出端(或其他模型的输出序列)引入一个特殊的

-

循环神经网络-转录器 (RNN-T - Recurrent Neural Network Transducer):

- 核心思想: 端到端模型的代表之一,被广泛应用于流式识别(可识别输入结束即可开始输出)。结合了 CTC 的想法,但结构更复杂。

- 结构: 包含一个编码器网络 (Encoder) 和一个预测网络 (Predictor Network) 和联合网络 (Joint Network)。

- 编码器: 将声学输入编码为高层表示(类似于编码器)。

- 预测网络: 一个 RNN(Prediction Network),根据已生成的输出历史预测下一个可能的输出符号(类似于语言模型解码器)。

- 联合网络: 将编码器和预测网络在每一步的输出向量融合,并通过一个全连接层预测一个 扩展的输出标签集(包含

<blank>)。

- 优势: 天然适合流式识别;同时整合了声学和语言信息;表现优异。是主流商业ASR系统(如谷歌语音搜索)中端到端方法的代表。

总结

- 传统主流: GMM-HMM (用于声学建模) 配合 DTW (用于特定场景),需要大量手动特征工程。

- 深度学习混合方法: DNN-HMM, CNN-HMM, LSTM/RNN-HMM (深度网络取代 GMM 作为 HMM 的观测概率估计器)。是目前许多实用系统的基石之一。

- 现代端到端方法 (主流研究方向):

- 注意力机制模型: Attention-based Seq2Seq (RNN + Attention, Transformer)

- 无对齐目标函数: CTC (常配合 RNN/LSTM/ConvNets)

- 整合声学语言模型: RNN-T (尤其适合流式)

- 基于自监督预训练: Transformer-based (Wav2Vec 系列, HuBERT, Whisper 等)

- 其他技术: 语言模型 (LM) 本身也是关键算法组件(如 N-gram, RNNLM, Transformer LM),用于约束解码、提升流畅性。模型压缩(量化、知识蒸馏、裁剪)和解码算法(WFST 解码、Beam Search)在实际部署中也至关重要。

建议: 选择哪种算法取决于具体应用场景(词表大小、实时性、精度要求、计算资源)、可用的训练数据量级以及系统设计的复杂度。目前基于 Transformer 的端到端模型(尤其是结合自监督预训练的)通常能提供最优性能,但在某些嵌入式或实时性要求极高的场景,优化后的 RNN-T 或 DNN-HMM 混合系统可能更实用。

智能语音识别测试-智能语音识别和交互设备的交互效果测试-验证设计算法

1970-01-01 08:00:00 至 1970-01-01 08:00:00

语音识别发展 Python进行语音识别案例

摘要:随着信息化时代的快速到来以及计算机技术的不断完善发展,语音识别在众多领域都得到了应用,同时语音

资料下载

![]() 香香技术员

2023-07-19 14:32:18

香香技术员

2023-07-19 14:32:18

NRK330X语音识别芯片离线语音唤醒模块资料说明书!

、智能照明、智能机电、智能家居、智能玩具等领域。内核和存储高性能32位RISC内核,主频240MHz,支持硬件浮点运算内置1MBSPIFLASHAI算法离线语音

资料下载

![]() 九芯电子语音IC

2021-12-11 09:28:22

九芯电子语音IC

2021-12-11 09:28:22

结合MFCC和特征的语音情感识别方法

用卷积神经网络提取图像特征。在此基础上,使用多核学习算法融合音频特征,并将生成的核函数应用于支持向量机进行情感分类。在2种语音情感数据集上的实验结果表明,与单一特征的分类器相比,该方法的

资料下载

佚名

2021-06-11 11:02:16

换一换

换一换

- 如何分清usb-c和type-c的区别

- 中国芯片现状怎样?芯片发展分析

- vga接口接线图及vga接口定义

- 芯片的工作原理是什么?

- 华为harmonyos是什么意思,看懂鸿蒙OS系统!

- 什么是蓝牙?它的主要作用是什么?

- ssd是什么意思

- 汽车电子包含哪些领域?

- TWS蓝牙耳机是什么意思?你真的了解吗

- 什么是单片机?有什么用?

- 升压电路图汇总解析

- plc的工作原理是什么?

- 再次免费公开一肖一吗

- 充电桩一般是如何收费的?有哪些收费标准?

- ADC是什么?高精度ADC是什么意思?

- EDA是什么?有什么作用?

- dtmb信号覆盖城市查询

- 中科院研发成功2nm光刻机

- 苹果手机哪几个支持无线充电的?

- type-c四根线接法图解

- 华为芯片为什么受制于美国?

- 怎样挑选路由器?

- 元宇宙概念股龙头一览

- 锂电池和铅酸电池哪个好?

- 什么是场效应管?它的作用是什么?

- 如何进行编码器的正确接线?接线方法介绍

- 虚短与虚断的概念介绍及区别

- 晶振的作用是什么?

- 大疆无人机的价格贵吗?大约在什么价位?

- 苹果nfc功能怎么复制门禁卡

- 单片机和嵌入式的区别是什么

- amoled屏幕和oled区别

- 复位电路的原理及作用

- BLDC电机技术分析

- dsp是什么意思?有什么作用?

- 苹果无线充电器怎么使用?

- iphone13promax电池容量是多少毫安

- 芯片的组成材料有什么

- 特斯拉充电桩充电是如何收费的?收费标准是什么?

- 直流电机驱动电路及原理图

- 传感器常见类型有哪些?

- 自举电路图

- 通讯隔离作用

- 苹果笔记本macbookpro18款与19款区别

- 新斯的指纹芯片供哪些客户

- 伺服电机是如何进行工作的?它的原理是什么?

- 无人机价钱多少?为什么说无人机烧钱?

- 以太网VPN技术概述

- 手机nfc功能打开好还是关闭好

- 十大公认音质好的无线蓝牙耳机