rbf神经网络原理

好的,我们来详细解释一下径向基函数(Radial Basis Function, RBF)神经网络的原理:

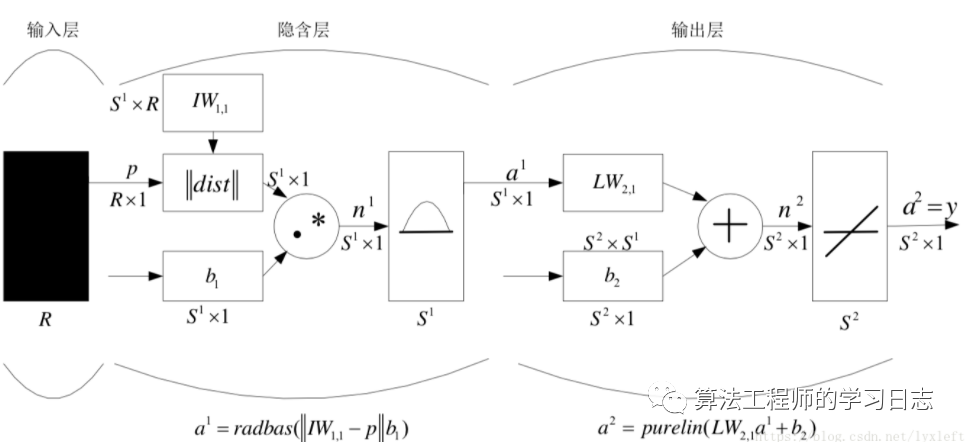

它是一种结构特殊、训练高效的前馈神经网络,常用于函数逼近、模式分类、时间序列预测等任务。其核心思想是:通过一组在输入空间中局部响应的基函数的线性组合来逼近复杂的非线性函数关系。

它的典型结构分为三层:

-

输入层:

- 接收输入数据向量

X = [x1, x2, ..., xn]^T。 - 节点数目等于输入特征的维度

n。 - 只是将输入信号传递到隐藏层,不做任何计算。

- 接收输入数据向量

-

隐藏层(径向基层):

- 核心层,实现了从输入空间到隐藏空间的非线性变换。

- 节点数目

m通常大于输入层节点数n,且可以根据需要设定(决定了网络的复杂度和逼近能力)。 - 每个隐藏层神经元对应一个“中心点”

C_j = [cj1, cj2, ..., cjn]^T(j=1,2,...,m)。这些中心点代表了输入空间中需要被“关注”的关键位置。 - 激活函数是径向基函数。最关键的特性是:其输出值只依赖于输入向量

X到该神经元中心点C_j的距离(通常是欧氏距离)的大小,而与方向无关。 - 最常用的径向基函数是高斯函数(Gaussian):

φ_j(X) = exp(-β_j * ||X - C_j||^2)||X - C_j||:输入向量X到中心C_j的欧几里得距离。β_j:称为宽度参数或扩展常数(通常β_j = 1/(2σ_j^2),其中σ_j是宽度)。它控制着函数峰值的“宽度”或“扩展范围”。β_j越大(σ_j越小),函数越尖锐,对中心点附近的响应越强烈,影响范围越小;反之,β_j越小(σ_j越大),函数越平缓,影响范围越广。

- 功能: 当输入

X靠近某个中心点C_j时,该隐藏神经元j的输出φ_j(X)接近最大值(通常为1);当X远离C_j时,φ_j(X)迅速衰减趋近于0。这体现了网络的 “局部响应” 特性。每个隐藏神经元像一盏“灯”,在输入空间中围绕其中心点照亮一个局部区域。输入点离哪个“灯”近,哪盏“灯”就亮。

-

输出层:

- 实现从隐藏层空间到输出空间的线性映射。

- 节点数目

k等于输出目标的维度(对于分类,可能是类别数;对于逼近,可能是预测值维度)。 - 每个输出节点的输出

y_k是所有隐藏层输出的加权线性组合:y_k = Σ_{j=1}^{m} w_{kj} * φ_j(X) + b_kφ_j(X):第j个隐藏神经元的输出。w_{kj}:连接第j个隐藏神经元到第k个输出神经元的权值。b_k:第k个输出神经元的偏置项(有时可以省略)。

- 功能: 输出层是一个简单的线性组合器。它把隐藏层提供的、表征输入

X在空间中相对位置(靠近哪些中心点)的非线性特征φ_j(X),通过一组线性权重w_{kj}综合起来,得到最终的输出预测y_k。

工作原理总结:

- 输入向量

X传入网络。 - 隐藏层计算

X到每个中心C_j的距离,并通过径向基函数(如高斯函数)计算出对应的激活值φ_j(X)。这些值衡量了X落入各个中心点“势力范围”的程度。 - 输出层将这些激活值

φ_j(X)乘以对应的权重w_{kj}并求和(加上可能的偏置),得到最终的输出值y_k。 - 整个网络通过调整 中心点

C_j、宽度参数β_j(或σ_j)和输出权重w_{kj},来学习输入X与输出y之间的复杂映射关系f(X) ≈ y。

训练过程(关键步骤):

RBF网络的训练通常分为两个相对独立的阶段,相比BP网络更高效:

-

无监督学习阶段(确定隐藏层参数):

- 目标: 确定隐藏层神经元的中心点

C_j和对应的宽度参数σ_j。 - 方法:

- 中心点

C_j: 最常用的是 聚类算法,尤其是 K-means 聚类。将训练数据集输入,运行K-means算法,聚类中心数设为隐藏层神经元数m。最终得到的m个聚类中心就作为隐藏神经元的中心点C_j。这些中心点试图覆盖原始输入数据分布的主要模式。 - 宽度参数

σ_j:- 常用方法是基于每个中心点

C_j到其最近的P个邻居中心点的平均距离来设定:σ_j = (1/P * Σ_{p=1}^{P} ||C_j - C_p||^2 )^{1/2} - 有时对所有神经元使用相同的全局宽度

σ,其值可设为所有中心点间最小距离的d_max / sqrt(2m)或平均距离的倍数等经验公式 (d_max是中心点间的最大距离,m是中心点数)。 - 目标是让每个基函数在空间中有适当的覆盖范围,既不重叠太多(导致冗余),也不分离太远(导致输入空间有“盲区”)。

- 常用方法是基于每个中心点

- 中心点

- 目标: 确定隐藏层神经元的中心点

-

监督学习阶段(确定输出层权重):

- 目标: 确定输出层的权重

w_{kj}和偏置b_k。 - 方法:

- 固定隐藏层参数(

C_j,σ_j)不变。 - 对于每一个训练样本

(X_p, T_p)(T_p是目标输出),计算其对应的隐藏层输出φ_j(X_p)(j=1..m)。 - 隐藏层的输出

φ_j(X_p)构成了一个P x m的矩阵Φ(P是训练样本数,m是隐藏神经元数)。 - 输出层是一个线性系统:

Φ * W = T(W是m x k的权重矩阵,包含w_{kj}和可能的b_k;T是P x k的目标输出矩阵)。 - 求解权重

W: 由于是线性系统,可以用高效的最小二乘法直接求解:W = Φ⁺ * T,其中Φ⁺是Φ的 伪逆矩阵 (也可以用正规方程W = (Φ^T Φ)^(-1) Φ^T T)。这避免了像BP那样需要迭代权重的梯度下降过程,计算速度快且通常能收敛到全局最优解(对于线性输出层)。

- 固定隐藏层参数(

- 目标: 确定输出层的权重

主要特点和对比(与BP网络):

- 局部响应: RBF网络的隐藏层激活具有局部性(高斯函数),输入只影响附近中心点对应的神经元。而BP(如Sigmoid/Tanh)的激活通常具有全局性(非零导数范围广)。

- 结构差异: RBF通常只有三层(输入、单隐藏径向基层、线性输出层)。BP可以有多个隐藏层。

- 训练效率: RBF隐藏层参数(中心、宽度)常通过无监督方法(如K-means)快速确定,输出层权重是线性问题可用最小二乘一步求解,训练速度通常远快于需要迭代梯度下降的BP网络。

- 逼近能力: 理论上,只要有足够多的隐藏神经元(即足够多的中心点),RBF网络能以任意精度逼近任何连续函数(万能逼近定理)。

- 解释性: 中心点和宽度参数通常具有较好的几何解释性(数据空间中的位置和影响范围)。

- 过拟合与欠拟合: 隐藏神经元数量

m是关键。m太小可能导致欠拟合(无法捕捉复杂模式);m太大可能导致过拟合(对小噪声敏感)和计算开销增大。 - 应用场景: 在训练速度要求高、输入输出关系可以用局部函数组合较好描述的场景下表现优秀(如插值、函数逼近、快速分类)。

总结: RBF神经网络利用输入点到中心点的距离作为基础,通过局部响应的径向基函数(如高斯函数)在隐藏层构造非线性特征,最后在输出层用线性加权求和的方式得到预测结果。其训练过程常分为无监督确定中心/宽度 + 监督线性求解权重两个高效步骤,使其在特定应用中成为比传统BP网络更快、更简单的替代方案。它的核心在于“距离度量”和“局部响应”。

什么是神经网络?什么是卷积神经网络?

在介绍卷积神经网络之前,我们先回顾一下神经网络的基本知识。就目前而言,神经网络是深度学习算法的核心,我们所熟知的很多深度学习算法的背后其实都是

2023-02-23 09:14:44

神经网络移植到STM32的方法

将神经网络移植到STM32最近在做的一个项目需要用到网络进行拟合,并且将拟合得到的结果用作控制,就在想能不能直接在单片机上做神经网络计算,这样就

RBF神经网络的优缺点讲解

RBF神经网络有很强的非线性拟合能力,可映射任意复杂的非线性关系,而且学习规则简单,便于计算机实现。具有很强的鲁棒性、记忆能力、非线性映射能力以及强大的自学习能力, 因此有很大的应用市场。

资料下载

![]() 姚小熊27

2021-03-24 15:59:12

姚小熊27

2021-03-24 15:59:12

基于BP神经网络的PID控制

最近在学习电机的智能控制,上周学习了基于单神经元的PID控制,这周研究基于BP神经网络的PID控制。神经网络具有任意非线性表达能力,可以通过对系

如何构建神经网络?

原文链接:http://tecdat.cn/?p=5725 神经网络是一种基于现有数据创建预测的计算系统。如何构建神经网络?神经网络包括:输入层

径向基函数神经网络芯片ZISC78电子资料

概述:ZISC78是由IBM和Sillicon联合研发的一种具有自学习功能的径向基函数神经网络芯片,它内含78个神经元;并且采用并行结构,运行速度与神经

【案例分享】ART神经网络与SOM神经网络

今天学习了两个神经网络,分别是自适应谐振(ART)神经网络与自组织映射(SOM)神经网络。整体感觉不是很难,只不过一些最基础的概念容易理解不清。

卷积神经网络如何使用

卷积神经网络(CNN)究竟是什么,鉴于神经网络在工程上经历了曲折的历史,您为什么还会在意它呢? 对于这些非常中肯的问题,我们似乎可以给出相对简明的答案。

换一换

换一换

- 如何分清usb-c和type-c的区别

- 中国芯片现状怎样?芯片发展分析

- vga接口接线图及vga接口定义

- 芯片的工作原理是什么?

- 华为harmonyos是什么意思,看懂鸿蒙OS系统!

- 什么是蓝牙?它的主要作用是什么?

- ssd是什么意思

- 汽车电子包含哪些领域?

- TWS蓝牙耳机是什么意思?你真的了解吗

- 什么是单片机?有什么用?

- 升压电路图汇总解析

- plc的工作原理是什么?

- 再次免费公开一肖一吗

- 充电桩一般是如何收费的?有哪些收费标准?

- ADC是什么?高精度ADC是什么意思?

- EDA是什么?有什么作用?

- dtmb信号覆盖城市查询

- 苹果手机哪几个支持无线充电的?

- type-c四根线接法图解

- 华为芯片为什么受制于美国?

- 怎样挑选路由器?

- 元宇宙概念股龙头一览

- 锂电池和铅酸电池哪个好?

- 什么是场效应管?它的作用是什么?

- 如何进行编码器的正确接线?接线方法介绍

- 虚短与虚断的概念介绍及区别

- 晶振的作用是什么?

- 大疆无人机的价格贵吗?大约在什么价位?

- 苹果nfc功能怎么复制门禁卡

- 单片机和嵌入式的区别是什么

- amoled屏幕和oled区别

- 复位电路的原理及作用

- BLDC电机技术分析

- dsp是什么意思?有什么作用?

- 苹果无线充电器怎么使用?

- iphone13promax电池容量是多少毫安

- 芯片的组成材料有什么

- 特斯拉充电桩充电是如何收费的?收费标准是什么?

- 直流电机驱动电路及原理图

- 传感器常见类型有哪些?

- 自举电路图

- 通讯隔离作用

- 苹果笔记本macbookpro18款与19款区别

- 新斯的指纹芯片供哪些客户

- 伺服电机是如何进行工作的?它的原理是什么?

- 无人机价钱多少?为什么说无人机烧钱?

- 以太网VPN技术概述

- 手机nfc功能打开好还是关闭好

- 十大公认音质好的无线蓝牙耳机

- 元宇宙概念龙头股一览