tanh

好的!tanh 的中文名称是双曲正切函数。

以下是关于 tanh 的关键信息:

-

定义:

- 它是双曲函数之一,与常见的三角函数类似,但基于双曲线而非圆定义。

- 其数学定义为:tanh(x) = sinh(x) / cosh(x)

- 也可以用指数函数表示:tanh(x) = (e^x - e^(-x)) / (e^x + e^(-x))

-

主要特性:

- 值域:tanh(x) 的输出值始终在 -1 和 1 之间 (

-1 < tanh(x) < 1)。 - 奇函数:tanh(-x) = -tanh(x),图形关于原点对称。

- 渐近线:当 x 趋近于正无穷大时,tanh(x) 趋近于 1;当 x 趋近于负无穷大时,tanh(x) 趋近于 -1。

- 过零点:tanh(0) = 0。

- 导数:tanh(x) 的导数是 1 - tanh²(x) 或 sech²(x)。这个性质非常重要,尤其在机器学习(如神经网络的反向传播)中。

- 值域:tanh(x) 的输出值始终在 -1 和 1 之间 (

-

图形:

- 是一条平滑的“S”形曲线,从左侧接近 -1 的位置,经过原点 (0,0),上升到右侧接近 1 的位置。它非常类似于 sigmoid 函数,但 sigmoid 的值域是 (0,1),而 tanh 的值域是 (-1,1),且关于原点中心对称。

-

与 tan 的区别:

tan(x)是圆(正切)函数,基于单位圆定义,是周期函数(周期为 π),其值域是全体实数(-∞ 到 +∞),并且在 π/2 + kπ 处有间断点(垂直渐近线)。tanh(x)是双曲正切函数,不是周期函数,值域严格限定在 (-1, 1) 之间,图形是平滑的 S 曲线,没有间断点。

-

应用:

- 神经网络/深度学习:tanh 曾是非常流行的激活函数(尤其是在循环神经网络 RNN 中),因为它能够将输入压缩到 (-1, 1) 的范围内,并且是零中心的(输出均值为0),这有时有助于后续层的学习。虽然现在 ReLU 及其变体更常用,但 tanh 仍会在特定场景或网络层中使用。

- 工程与物理:在解决涉及悬链线、热传导、相对论速度叠加等问题时会出现。

- 数学:解决某些微分方程。

简单比喻: 想象一个磁铁在滑轨上滑动,滑轨的两端各有一个强磁极(N极和S极)。当磁铁靠近N极时会被强力吸引(趋近+1),靠近S极时会被强力吸引(趋近-1),在中间位置(原点)不受力(值为0)。tanh 函数就描述了磁铁位置与所受“吸引力归一化后的数值”之间的关系。

希望这个中文解释对您有帮助!如果您想了解更具体的方面(比如公式推导、应用实例、与sigmoid的比较、如何计算等),请随时追问。

激活函数ReLU的理解与总结

应用。 ReLU上界设置: ReLU相比sigmoid和tanh的一个缺点是没有对上界设限.在实际使用中,可以设置一个上限,如ReLU6经验函数: f(x)=min(6,max(0,x

BP神经网络的基本原理

输入层、隐藏层和输出层组成。其中,输入层负责接收外部输入数据,这些数据随后被传递到隐藏层。隐藏层是BP神经网络的核心部分,它可以通过一层或多层神经元对输入数据进行加权求和,并通过非线性激活函数(如ReLU、sigmoid或tanh)进行处理,从而提取出数据中的特征。最后,经过所有

2025-02-12 15:13:37

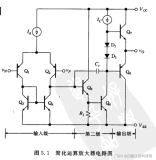

运放内部电路结构及仿真

ic1 / ic2 = exp [ (Vn-Vp) / VT ] 联立上面的几个关系式得出 io=IA*Tanh[ (Vn-Vp) / 2VT ] 这样也从上面的io输出可以看出当Vn=Vp的时候,理论上来是io应该是

2024-12-24 09:14:24

深度神经网络模型有哪些

、Sigmoid或Tanh。 卷积神经网络(Convolutional Neural Networks,CNN): 卷积神经网络是深度学习中最重

2024-07-02 10:00:01

【触觉智能 Purple Pi OH 开发板体验】四、(Ubuntu)OpenCV手写数字识别

的激活函数包括sigmoid函数、ReLU和tanh(x)等,它们的输出均可以为0或1。二、开发环境配置运行开发好的程序,提示报错Cv2错误,OpenCV安装环境问题,接下来安装相关配置。3.1、安装

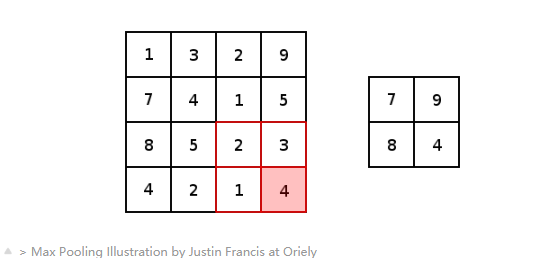

一文详解CNN

: sigmoid tanh relu 它们各自有其优缺点,现在常用的是relu,其不需要指数运算,复杂度低,且不会出现梯度饱和、消失问题,收敛速度快。 2.5 Softmax层

一层卷积能做啥?一层卷积可以做超分吗?

= nn.Sequential( nn.Conv2d(D, S, 3, 1, 1), nn.Tanh(), nn.Conv2d(S,2ss*C,3,1,1,bias=False

神经网络在训练时常用的一些损失函数介绍

层中,必须使用tanh激活函数的单个节点以输出介于 -1 和 1 之间的单个值。下面是完整代码:比交叉熵略差的性能,在训练和测试集上的准确性不到80%。下图可以看出,模型已经收敛,分类精度图表明也已经收敛。原作者:Deephub Onepagecode

最近在弄一个RISC-V RV32IMCF + AIPU的硬件板子

, Relu/PRelu/LeakyRelu/Tanh/Sigmoid 激 活,Concat/Reshape/BatchNomalizationn 等常见神经网络算子。:) 有要一起玩的小伙伴吗?论坛留言,或者可以加我微信sz-qvc

AlexNet架构的独特特征解析

为了训练神经网络内的神经元,利用Tanh或S形非线性已成为标准做法,这是goto激活函数,可用来对CNN内的内部神经元激活进行建模。

2020-07-14 09:17:28

换一换

换一换

- 如何分清usb-c和type-c的区别

- 中国芯片现状怎样?芯片发展分析

- vga接口接线图及vga接口定义

- 芯片的工作原理是什么?

- 华为harmonyos是什么意思,看懂鸿蒙OS系统!

- 什么是蓝牙?它的主要作用是什么?

- ssd是什么意思

- 汽车电子包含哪些领域?

- TWS蓝牙耳机是什么意思?你真的了解吗

- 什么是单片机?有什么用?

- 升压电路图汇总解析

- plc的工作原理是什么?

- 再次免费公开一肖一吗

- 充电桩一般是如何收费的?有哪些收费标准?

- ADC是什么?高精度ADC是什么意思?

- EDA是什么?有什么作用?

- dtmb信号覆盖城市查询

- 中科院研发成功2nm光刻机

- 苹果手机哪几个支持无线充电的?

- type-c四根线接法图解

- 华为芯片为什么受制于美国?

- 怎样挑选路由器?

- 元宇宙概念股龙头一览

- 锂电池和铅酸电池哪个好?

- 什么是场效应管?它的作用是什么?

- 如何进行编码器的正确接线?接线方法介绍

- 虚短与虚断的概念介绍及区别

- 晶振的作用是什么?

- 大疆无人机的价格贵吗?大约在什么价位?

- 苹果nfc功能怎么复制门禁卡

- 单片机和嵌入式的区别是什么

- amoled屏幕和oled区别

- 复位电路的原理及作用

- BLDC电机技术分析

- dsp是什么意思?有什么作用?

- 苹果无线充电器怎么使用?

- iphone13promax电池容量是多少毫安

- 芯片的组成材料有什么

- 特斯拉充电桩充电是如何收费的?收费标准是什么?

- 直流电机驱动电路及原理图

- 传感器常见类型有哪些?

- 自举电路图

- 通讯隔离作用

- 苹果笔记本macbookpro18款与19款区别

- 新斯的指纹芯片供哪些客户

- 伺服电机是如何进行工作的?它的原理是什么?

- 无人机价钱多少?为什么说无人机烧钱?

- 以太网VPN技术概述

- 手机nfc功能打开好还是关闭好

- 十大公认音质好的无线蓝牙耳机