机器学习分类方法

更多

好的,机器学习中的分类方法是监督学习的一个重要分支,其目标是根据输入特征(自变量) 将数据样本预测或划分到预定义的离散类别(因变量/目标变量) 中。简单说,就是让机器学会“贴标签”。

以下是几种核心且常用的分类方法(用中文解释):

-

逻辑回归:

- 核心思想: 虽然名字里有“回归”,但它是一种概率型分类模型。它通过一个Sigmoid函数,将线性回归的输出映射到

(0, 1)区间,代表样本属于某个类别(通常是正类)的概率。 - 特点: 简单、高效、可解释性好(可以看到每个特征的权重)。通常用于二分类问题(例如:垃圾邮件识别:是/否)。

- 适用场景: 特征和目标变量大致呈线性关系、需要概率输出的二分类问题。

- 核心思想: 虽然名字里有“回归”,但它是一种概率型分类模型。它通过一个Sigmoid函数,将线性回归的输出映射到

-

决策树:

- 核心思想: 模仿人类做决策的过程。通过一系列基于特征的“是/否”问题(内部节点),将数据层层划分(分支),最终到达代表预测类别的叶子节点。目标是通过提问,使得同一叶子节点内的样本尽可能属于同一类。

- 特点: 非常直观、易于理解和可视化(规则清晰)。不需要很多数据预处理(能处理类别特征、缺失值)。容易过拟合(对训练数据记忆太好,在新数据上表现差)。

- 适用场景: 可解释性要求高、特征有明确逻辑关系的问题,也可处理多分类。

-

随机森林:

- 核心思想: 决策树的“集大成者”。核心是Bagging思想:

-

- 构建多个(成百上千棵)不同的决策树(树的多样性是关键)。

-

- 通过有放回地随机抽样生成多份训练数据子集。

-

- 在每个数据子集上训练一棵树。

-

- 在树的每个分裂节点选择特征时,仅考虑特征的一个随机子集(而不是所有特征)。

-

- 最终预测结果由所有树投票(分类问题)或平均(回归问题)决定。

- 特点: 通常比单棵决策树准确率高很多、更鲁棒(不易过拟合)、能自动评估特征重要性。但模型可解释性不如单棵树、训练和预测速度相对慢(树很多时)。

- 适用场景: 对准确性要求高、特征间可能存在复杂交互、数据存在噪声的场景。是非常通用且强大的方法。

- 核心思想: 决策树的“集大成者”。核心是Bagging思想:

-

支持向量机:

- 核心思想: 找到一个超平面(在二维就是一条直线,三维是平面,更高维类推)来最大程度地分隔不同类别的样本点。这个“最大程度”体现在找到使得样本点到超平面的“间隔”最大的位置。那些定义了间隔边界的关键样本点称为“支持向量”。

- 核技巧: 当数据在原始特征空间中线性不可分时,SVM可以利用“核函数”将数据隐式地映射到更高维的空间,使得在高维空间中变得线性可分(例如:将二维平面上的圈圈点点用核函数映射到三维空间,可能就能用一个平面分开了)。

- 特点: 在高维空间中效果很好,尤其在小样本数据集上。对模型复杂性控制较好(间隔最大化的目标本身有助于防止过拟合)。训练复杂度较高,尤其在大数据集上;结果不如决策树直观;选择合适的核函数和参数需要技巧。

- 适用场景: 高维数据、小样本数据、非线性可分但边界相对清晰的问题。

-

K-最近邻:

- 核心思想: “近朱者赤,近墨者黑”。对于一个待预测的样本,查看它在特征空间中最邻近的 K 个训练样本(邻居),这 K 个邻居中哪个类别的样本最多,就预测该样本属于哪个类别。

- 特点: 非常简单直观,是一种“懒惰学习”(训练快,仅存储数据;预测慢,需要计算所有距离)。预测准确度高度依赖距离度量的定义和 K 值的选择。对数据的局部结构敏感。

- 适用场景: 数据集相对较小且低维,特征和类别的局部相关性较强时效果可能不错。通常不是首选方法,但在某些特定场景(如推荐系统的协同过滤)中有应用。

-

朴素贝叶斯:

- 核心思想: 基于贝叶斯定理和特征条件独立性假设(“朴素”即源于此假设)。它计算在给定特征组合出现时,各个类别发生的概率,并预测概率最大的那个类别。

- 朴素地假设各个特征之间是相互独立的(现实中常不成立)。

- 特点: 训练和预测速度都非常快,尤其适合高维特征(如文本分类)。在小数据集上也能表现良好。由于条件独立性假设,特征间的复杂关系建模能力有限。

- 适用场景: 文本分类、垃圾邮件过滤、高维稀疏数据的快速建模。

-

神经网络:

- 核心思想: 受到人脑神经元连接启发。由多层互连的“神经元”(节点)组成。数据从输入层进入,经过一个或多个隐藏层的非线性变换(使用激活函数),最终在输出层得到预测(对于分类,输出层常用Softmax函数给出每个类别的概率)。

- 深度学习: 包含多个隐藏层的神经网络。

- 特点: 能自动学习数据的层次化特征表示,建模能力极其强大(理论上可以逼近任意复杂函数),在图像、语音、自然语言处理等领域取得了革命性成果。但通常需要大量数据和计算资源(GPU)进行训练,模型像“黑盒”,可解释性差,调参复杂容易过拟合。

- 适用场景: 拥有海量数据的复杂问题(如图像识别、语音识别、机器翻译等),或者特征工程困难的问题(神经网络能自动学习特征)。

其他重要概念和分类方式:

- 二分类 vs 多分类: 上述方法大多能处理多分类问题,逻辑回归可推广为Softmax回归,SVM可推广为“一对多”或“一对一”策略。

- 线性分类器 vs 非线性分类器:

- 线性: 逻辑回归(决策边界是线性)、SVM(线性核)等。试图用直线/平面/超平面分割类别。

- 非线性: 决策树、随机森林、KNN、带核函数的SVM、神经网络等。可以学习更复杂的非线性决策边界。

- 概率型模型 vs 非概率型模型:

- 概率型: 逻辑回归、朴素贝叶斯提供样本属于各个类别的概率(如“此邮件是垃圾邮件的概率为95%”)。

- 非概率型: 如SVM(标准形式)、决策树通常只给出类别标签,不直接输出概率(虽然有些可以通过校准得到概率)。

- 判别式模型 vs 生成式模型:

- 判别式: 直接学习数据特征与目标类别之间的决策边界。例如:逻辑回归、SVM、决策树、随机森林、神经网络。关注“如何区分”。

- 生成式: 试图学习数据的生成方式(数据的联合概率分布 P(特征, 类别)),然后利用贝叶斯定理推导出分类规则。例如:朴素贝叶斯。关注“数据是如何产生的”。

选择哪种方法?

没有绝对最好的方法,取决于:

- 数据规模和性质: 数量大小?维度高低?线性可分?噪声多少?特征类型(数值、类别)?标签不平衡?

- 问题复杂度: 边界是否简单清晰?

- 计算资源: 训练/预测时间、内存限制?

- 模型可解释性要求: 是否需要理解模型为何这样预测?

- 精度要求: 最关心准确率、召回率、还是其他指标?

常见做法:

- 从简单模型开始: 如逻辑回归、朴素贝叶斯、KNN,作为基线模型。

- 尝试强大的集成模型: 如随机森林、梯度提升树(如XGBoost, LightGBM, CatBoost),它们在很多表格数据比赛中表现优异。

- 对于复杂模式(尤其是非结构化数据): 考虑神经网络。

- 需要规则解释时: 决策树、规则列表。

选择哪种分类器最好?最可靠的答案是:实践出真知! 根据你的具体数据和问题,尝试几种方法,并通过交叉验证比较它们的性能才是关键。

希望这个中文解释对你有帮助!你想深入了解哪种方法的细节,或者你的应用场景是什么?

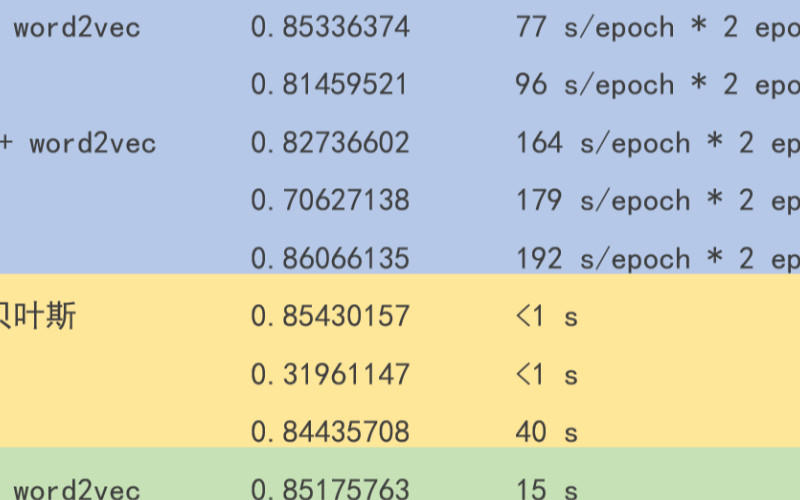

基于机器学习的恶意代码检测分类

基于特征码匹配的静态分析方法提取的特征滞后于病毒发展,且不能检测出未知病毒。为此,从病毒反编译文件及其灰度图出发进行特征提取及融合,采用机器学习

资料下载

佚名

2021-06-10 11:03:15

7天热门专题

换一换

换一换

换一换

换一换

- 如何分清usb-c和type-c的区别

- 中国芯片现状怎样?芯片发展分析

- vga接口接线图及vga接口定义

- 芯片的工作原理是什么?

- 华为harmonyos是什么意思,看懂鸿蒙OS系统!

- 什么是蓝牙?它的主要作用是什么?

- ssd是什么意思

- 汽车电子包含哪些领域?

- TWS蓝牙耳机是什么意思?你真的了解吗

- 什么是单片机?有什么用?

- 升压电路图汇总解析

- plc的工作原理是什么?

- 再次免费公开一肖一吗

- 充电桩一般是如何收费的?有哪些收费标准?

- ADC是什么?高精度ADC是什么意思?

- EDA是什么?有什么作用?

- dtmb信号覆盖城市查询

- 中科院研发成功2nm光刻机

- 苹果手机哪几个支持无线充电的?

- type-c四根线接法图解

- 华为芯片为什么受制于美国?

- 怎样挑选路由器?

- 元宇宙概念股龙头一览

- 锂电池和铅酸电池哪个好?

- 什么是场效应管?它的作用是什么?

- 如何进行编码器的正确接线?接线方法介绍

- 虚短与虚断的概念介绍及区别

- 晶振的作用是什么?

- 大疆无人机的价格贵吗?大约在什么价位?

- 苹果nfc功能怎么复制门禁卡

- 单片机和嵌入式的区别是什么

- amoled屏幕和oled区别

- 复位电路的原理及作用

- BLDC电机技术分析

- dsp是什么意思?有什么作用?

- 苹果无线充电器怎么使用?

- iphone13promax电池容量是多少毫安

- 芯片的组成材料有什么

- 特斯拉充电桩充电是如何收费的?收费标准是什么?

- 直流电机驱动电路及原理图

- 传感器常见类型有哪些?

- 自举电路图

- 通讯隔离作用

- 苹果笔记本macbookpro18款与19款区别

- 新斯的指纹芯片供哪些客户

- 伺服电机是如何进行工作的?它的原理是什么?

- 无人机价钱多少?为什么说无人机烧钱?

- 以太网VPN技术概述

- 手机nfc功能打开好还是关闭好

- 十大公认音质好的无线蓝牙耳机