2025年HBM已售罄,存储大厂加快HBM4进程

描述

电子发烧友网报道(文/黄晶晶)近日,继闪迪、长江存储向渠道发布了涨价通知后,美光科技向客户发出的涨价函在渠道曝光。涨价函显示,美光观察到各个业务部门的需求显著增加,美光决定将面向渠道合作伙伴提高产品价格。据CFM闪存市场的消息,美光此次涨价幅度将在10%-15%。另电子发烧友网了解到,此前市场传出美光要求NAND闪存芯片涨价约为11%。

此番涨价普遍认为是原厂减产叠加终端回升助推了闪存的需求。另一方面,HBM高带宽存储在AI时代得到广泛应用,HBM成为存储芯片大厂的投入重点。据集邦咨询早前预测,预计到2025 年HBM的价格将上涨5-10%。同时,我们可以看到,DeepSeek带动端侧AI需求,也将加速DDR5等内存产品的市场渗透。

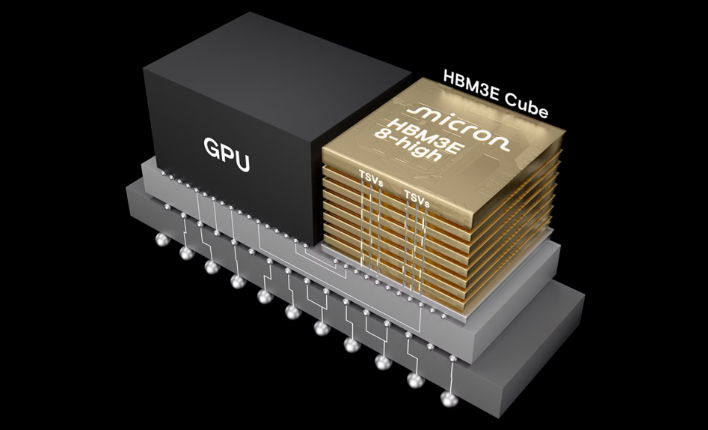

近日,美光再次表示,在同一节点生产同等容量的情况下,最先进的HBM3E内存对晶圆量的消耗是标准DDR5内存的三倍。无疑对HBM的投入将可能进一步导致常规DRAM出现供应短缺。

据韩媒报道,SK海力士CEO郭鲁正在股东大会上表示,尽管人工智能(AI)公司调整投资速度,以及出现中国DeepSeak等低成本AI模型,但HBM市场的增长仍将保持不变。SK海力士今年的HBM产能已经售罄,明年产能计划将在上半年完成与客户的最终协商。

HBM高带宽内存即将进入HBM4时代,存储芯片厂商正加速这一进程。近期,SK海力士宣布了12层HBM4开始向客户送样。美光也表示2025年HBM已售罄,并且HBM4的推出时机与客户需求高度契合,将于2026年实现量产。

SK海力士HBM4

SK海力士实际上是比原计划提早实现12层HBM4的样品出货,并已开始与客户的验证流程。公司将在下半年完成量产准备。

此番涨价普遍认为是原厂减产叠加终端回升助推了闪存的需求。另一方面,HBM高带宽存储在AI时代得到广泛应用,HBM成为存储芯片大厂的投入重点。据集邦咨询早前预测,预计到2025 年HBM的价格将上涨5-10%。同时,我们可以看到,DeepSeek带动端侧AI需求,也将加速DDR5等内存产品的市场渗透。

近日,美光再次表示,在同一节点生产同等容量的情况下,最先进的HBM3E内存对晶圆量的消耗是标准DDR5内存的三倍。无疑对HBM的投入将可能进一步导致常规DRAM出现供应短缺。

据韩媒报道,SK海力士CEO郭鲁正在股东大会上表示,尽管人工智能(AI)公司调整投资速度,以及出现中国DeepSeak等低成本AI模型,但HBM市场的增长仍将保持不变。SK海力士今年的HBM产能已经售罄,明年产能计划将在上半年完成与客户的最终协商。

HBM高带宽内存即将进入HBM4时代,存储芯片厂商正加速这一进程。近期,SK海力士宣布了12层HBM4开始向客户送样。美光也表示2025年HBM已售罄,并且HBM4的推出时机与客户需求高度契合,将于2026年实现量产。

SK海力士HBM4

SK海力士实际上是比原计划提早实现12层HBM4的样品出货,并已开始与客户的验证流程。公司将在下半年完成量产准备。

SK海力士表示,此次提供的12层HBM4样品,兼具了面向AI的存储器必备的世界最高水平速率。其容量也是12层堆叠产品的最高水平。

此产品首次实现了最高每秒可以处理2TB(太字节)以上数据的带宽。其相当于在1秒内可处理400部以上全高清(Full-HD,FHD)级电影(5GB=5千兆字节)的数据,运行速度与前一代(HBM3E)相比提高了60%以上。

同时,公司通过在该产品上采用已在前一代产品获得竞争力认可的Advanced MR-MUF工艺,实现了现有12层HBM可达到的最大36GB容量。通过此工艺控制芯片的翘曲现象,还有效提升散热性能,由此最大程度地提高产品的稳定性。

美光HBM3E和HBM4

美光FY2025Q2财季(2024年12月-2025年2月)业绩显示,其Compute and Networking(CNBU)营收45.64亿美元,环比增长4%,占总收入的57%。得益于HBM收入环比增长超50%,CNBU收入连续第三个季度创下季度新高。

HBM市场需求依然强劲,美光预计2025日历年HBM总市场规模将达350亿美元以上,比之前预估的300亿美元有所提高,并预计2025年第四季度有望HBM份额达到与整体DRAM供应份额相当的水平。

美光表示,2025日历年HBM已售罄,而2026年HBM市场需求将保持强劲态势,目前,正在与客户就2026日历年HBM需求协议进行讨论。

美光HBM3E与竞品相比功耗可降低30%,且美光12层堆叠HBM3E(HBM3E 12H)比竞争对手的8层堆叠产品的功耗降低了20%,同时内存容量提高了50%。目前美光已开始批量生产HBM3E 12H,并专注于提高产能和良率,预计2025年下半年,HBM3E 12H将占HBM总出货量的绝大部分。

此产品首次实现了最高每秒可以处理2TB(太字节)以上数据的带宽。其相当于在1秒内可处理400部以上全高清(Full-HD,FHD)级电影(5GB=5千兆字节)的数据,运行速度与前一代(HBM3E)相比提高了60%以上。

同时,公司通过在该产品上采用已在前一代产品获得竞争力认可的Advanced MR-MUF工艺,实现了现有12层HBM可达到的最大36GB容量。通过此工艺控制芯片的翘曲现象,还有效提升散热性能,由此最大程度地提高产品的稳定性。

美光HBM3E和HBM4

美光FY2025Q2财季(2024年12月-2025年2月)业绩显示,其Compute and Networking(CNBU)营收45.64亿美元,环比增长4%,占总收入的57%。得益于HBM收入环比增长超50%,CNBU收入连续第三个季度创下季度新高。

HBM市场需求依然强劲,美光预计2025日历年HBM总市场规模将达350亿美元以上,比之前预估的300亿美元有所提高,并预计2025年第四季度有望HBM份额达到与整体DRAM供应份额相当的水平。

美光表示,2025日历年HBM已售罄,而2026年HBM市场需求将保持强劲态势,目前,正在与客户就2026日历年HBM需求协议进行讨论。

美光HBM3E与竞品相比功耗可降低30%,且美光12层堆叠HBM3E(HBM3E 12H)比竞争对手的8层堆叠产品的功耗降低了20%,同时内存容量提高了50%。目前美光已开始批量生产HBM3E 12H,并专注于提高产能和良率,预计2025年下半年,HBM3E 12H将占HBM总出货量的绝大部分。

美光HBM3E 12H提供了36GB容量,比当前的HBM3E8-high产品增加50%,允许更大的AI模型,如具有700亿个参数的Llama2在单个处理器上运行。这种容量的增加避免了CPU卸载和GPU-GPU通信延迟,从而加快了运行时间。

此外,其功耗显著低于竞争对手的 HBM3E8-high24GB解决方案。美光 HBM3E12高速36GB提供超过每秒1.2太字节(TB/s)的内存带宽,引脚速度超过9.2Gb/s。美光HBM3E的这些综合优势提供了最高吞吐量和最低功耗,可以确保对电力需求大的数据中心获得最佳结果。

美光HBM平台和客户认证取得了良好进展,HBM3E 8H已应用于英伟达GB200,HBM3E 12H将应用于GB300。第二财季,美光开始向第三大HBM3E客户批量出货,并会有更多的客户。预计在2025财年HBM收入将达到数十亿美元。

随着美光继续专注于扩展其行业领先地位,公司已经着眼于未来的HBM4和HBM4E路线图。

美光HBM4将于2026年实现量产。HBM4与HBM3E相比其带宽增加了60%以上。HBM4的推出时机与客户需求高度契合,美光将专注于向市场提供能效、质量与性能等方面最优的HBM4产品。

美光预计FY25Q3净资本支出将超过30亿美元。美光2025财年全年资本支出计划仍为约140亿美元。其中,绝大部分资本支出将用于支持高带宽内存(HBM)业务,以及设施建设、后端制造和研发投资。

美光正专注于在现有制造设施中提升HBM产能,以满足至2026年的市场需求。今年1月,美光在新加坡的HBM先进封测工厂破土动工,这项投资将使美光自2027日历年开始显著提升总先进封装产能。与此同时,其在爱达荷州新建的DRAM工厂在本季度完成了关键里程碑节点,成功获得CHIPS法案对该项目的首笔资金拨付。这座全新的爱达荷州工厂预计将于2027财年开始贡献可观的DRAM产量。

2026年英伟达Rubin GPU搭载8个36GB HBM4

台媒宣称,英伟达将于2026 年推出的下一代 AI GPU产品Rubin将导入多制程节点芯粒(Chiplet)设计,其中计算芯片采用台积电N3P制程,对PPA要求较低的I/O芯片则会使用 N5B节点。

每个Rubin GPU将包含2颗计算芯片和1颗I/O芯片,整体采用SoIC三维垂直堆叠先进封装工艺集成,然后再使用CoWoS工艺连接8个36GB HBM4 片外内存堆栈。

美光表示,近期大型超大规模客户重申了其在2025日历年资本投资将实现同比强劲增长。预计 2025 年服务器出货量将实现中个位数百分比增长,传统服务器和AI服务器均将实现增长。可以看到,需求的稳健增长进一步支撑了HBM市场的发展。

小结:

HBM配合GPU应用于AI训练,在数据中心市场获得成功。从目前各家存储芯片厂商适配英伟下一代GPU来看,最先进HBM产品仍然有着乐观的前景。另一方面,随着AI推理在更多新兴应用场景落地,HBM有望跟随GPU下沉至一体机等终端,且具有相当可观的规模。届时HBM的成本是否会进一步下降,从而可应用于更多端侧推理场景。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

HBM3E量产后,第六代HBM4要来了!2024-07-28 7575

-

三星正在开发HBM4 目标2025年供货2023-10-11 1616

-

SK海力士提前完成HBM4内存量产计划至2025年2024-05-06 1677

-

SK海力士明年HBM产能基本售罄2024-05-07 1201

-

三星电子组建HBM4独立团队,力争夺回HBM市场领导地位2024-05-10 1509

-

SK海力士加速HBM4E内存研发,预计2026年面市2024-05-14 1216

-

台积电在欧洲技术研讨会上展示HBM4的12FFC+和N5制造工艺2024-05-17 1835

-

台积电将采用HBM4,提供更大带宽和更低延迟的AI存储方案2024-05-20 2060

-

台积电准备生产HBM4基础芯片2024-05-21 1756

-

SK海力士HBM4芯片前景看好2024-05-30 1884

-

特斯拉或向SK海力士、三星采购HBM4芯片2024-11-21 1887

-

特斯拉欲将HBM4用于自动驾驶,内存大厂加速HBM4进程2024-11-28 3818

-

美光发布HBM4与HBM4E项目新进展2024-12-23 1823

-

Cadence推出HBM4 12.8Gbps IP内存系统解决方案2025-05-26 1848

-

美光确认HBM4将在2026年Q2量产2025-09-26 2504

全部0条评论

快来发表一下你的评论吧 !