跨语言提示:改进跨语言零样本思维推理

Transformer的主要概念

LLaMA微调显存需求减半,清华提出4比特优化器

掌握基于Transformer的目标检测算法的3个难点

X-RiSAWOZ: 高质量端到端多语言任务型对话数据集

机器翻译研究进展

为k近邻机器翻译领域自适应构建可解释知识库

LLM时代NLP研究何去何从?

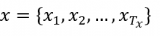

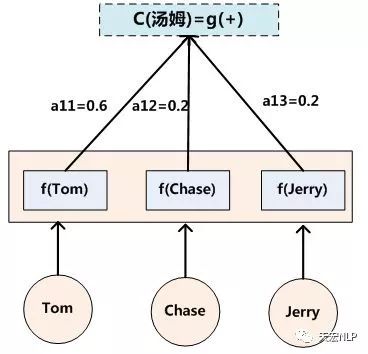

简述深度学习中的Attention机制

Transformer的细节和效果如何

Meta开源NLLB翻译模型,支持200种语言互译

基于选择机制的自注意力网络模型

神经网络时代,中文分词还有必要吗?

2019年冬季CS224N最新课程:基于深度学习的自然语言处理

自然语言处理中极其重要的句法分析

为大家介绍三个NLP领域的热门词汇

什么是Transition-based基于转移的框架?

为什么要有attention机制,Attention原理

深入了解图神经网络背后的原理和其强大的表征能力

如此强大的机器翻译架构内部的运行机制究竟是怎样的?