GPT系列模型演进与启示

一种基于正交与缩放变换的大模型量化方法

GPT架构及推理原理

GPT的定义和演进历程

如何加速大语言模型推理

OpenAI新研究:指令层次结构防御LLM攻击策略

深入理解 Sora 的技术原理

复盘与分析:Sora是如何成功的?

谷歌大型模型终于开放源代码,迟到但重要的开源战略

快速全面了解大模型长文本能力

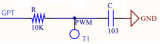

用GPT写个mexFunction

Continous Batching大模型推理关键技术

两种端到端的自动驾驶系统算法架构

大模型智能的革命:如何打破算力瓶颈

LLMs时代进行无害性评估的基准解析

首个无需依赖SAM的高效像素级推理大模型PixelLM问世

如何使用GPT监控变量

从Google多模态大模型看后续大模型应该具备哪些能力

GPT推断中的批处理(Batching)效应简析

探索高效的大型语言模型!大型语言模型的高效学习方法