资料下载

深入分析无人驾驶硬件平台

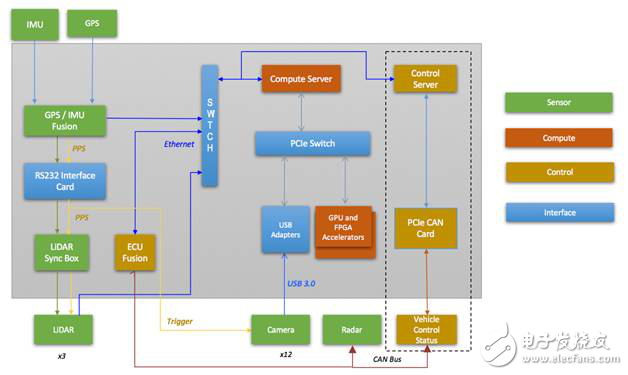

无人驾驶技术是多个技术的集成,如图1所示,一个无人驾驶系统包含了多个传感器,包括长距雷达、激光雷达、短距雷达、车载摄像头、超声波、 GPS、 陀螺仪等。每个传感器在运行时都不断产生数据,而且系统对每个传感器产生的数据都有很强的实时处理要求。比如摄像头需要达到60 FPS的帧率,意味着留给每帧的处理时间只有16毫秒。但当数据量增大了之后,分配系统资源便成了一个难题。例如,当大量的激光雷达点云数据进入系统,占满CPU资源,就很可能令摄像头的数据不能得到及时的处理,导致无人驾驶系统错过交通灯的识别,造成严重后果。因此,合理地选择计算平台完成实时的大规模传感数据处理,进行实时的驾驶预警与决策,对无人驾驶的安全性、可靠性、持续性至关重要。在提供高性能的数据处理支持的同时,计算平台还需要兼顾功耗、散热、硬件体积等问题,这对于持续的安全行驶同样重要。因此,在现有无人车计算平台中,各种硬件模块都有相关集成解决方案。不同的计算单元通过Switch或PCIe Switch相连,进行数据交换,完成协同运算。无人驾驶中除了需要对智能驾驶相关的传感器数据进行计算与决策,还需要传统汽车中各个机械部件进行配合控制,完成驾驶操作的执行与转换。这就需要控制平台:ECU与通信总线的协助。ECU从用途上讲是汽车专用微机控制器,它使用一套以精确计算和大量实验数据为基础的固定程序,不断地比较和计算各个机械部件传感器的数据,然后发出指令,完成机械控制。通信总线如CAN、USB3.0、LIN等则是在这个过程中实现汽车数据共享以及指令的有效传达。

图1 无人驾驶硬件平台范例

传感器平台

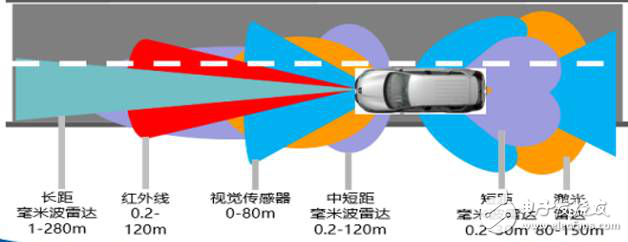

目前现有的车载传感器包括超声波雷达、激光雷达、毫米波雷达、车载摄像头、红外探头等。目前主流的无人驾驶传感平台以激光雷达和车载摄像头为主,并呈现多传感器融合发展的趋势。基于测量能力和环境适应性,预计激光雷达和车载摄像头会持续传感器平台霸主的地位,并不断与多种传感器融合,发展出多种组合版本。完备的无人驾驶系统应该如图2所示,各个传感器之间借助各自所长相互融合、功能互补、互为备份、互为辅助。

图2 各种传感器在无人驾驶中的应用激光雷达

激光雷达的工作原理是利用可见和近红外光波(多为950nm波段附近的红外光)发射、反射和接收来探测物体。激光雷达可以探测白天或黑夜下的特定物体与车之间的距离。由于反射度的不同,也可以区分开车道线和路面,但是无法探测被遮挡的物体、光束无法达到的物体,在雨雪雾天气下性能较差。

激光雷达在无人驾驶运用中拥有两个核心作用。3D建模进行环境感知。通过雷射扫描可以得到汽车周围环境的3D模型,运用相关算法比对上一帧和下一帧环境的变化可以较为容易的探测出周围的车辆和行人。

SLAM加强定位。3D雷射雷达另一大特性是同步建图(SLAM),实时得到的全局地图通过和高精度地图中特征物的比对,可以实现导航及加强车辆的定位精度。

激光雷达分类与产品

LIDAR以单线/多线及距离两大因素为标准,价格从几百美金到几万美金不等。单线激光雷达的应用在国内已经相对较广,像扫地机器人使用的便是单线激光雷达。单线激光雷达可以获取2D数据,但无法识别目标的高度信息。而多线激光雷达则可以识别2.5D甚至是3D数据,在精度上会比单线雷达高很多。目前在国际市场上推出的主要有4线、8线、16线、32线和64线。随着线数的提升,其识别的数据点也随之增加,所要处理的数据量也非常巨大。比如,Velodyne的HDL-32E 传感器每秒能扫描70万个数据点,而百度无人车和Google无人车配备的Velodyne HDL-64E通过64束的雷射束进行垂直范围26.8度,水平360度的扫描,每秒能产生的数据点则高达130万。Velodyne HDL-64E的内部结构如图3,主要由上下两部分组成。每部分都发射32束的雷射束,由两块16束的雷射发射器组成,背部是包括信号处理器和稳定装置。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。 举报投诉

- 相关下载

- 相关文章

下载排行榜

- 暂无相关数据