资料下载

×

基于CNN的图文融合媒体的情感分析方法

消耗积分:1 |

格式:rar |

大小:0.77 MB |

2017-12-23

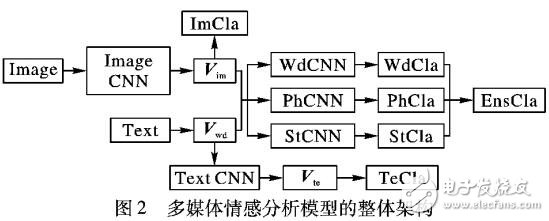

近年来,用户在社交媒体上越来越多地使用多媒体内容来分享经历和表达情绪。相比单独的文本和图像,融合文本和图像的多媒体内容能够更为充分地揭示用户的真实情感。针对单一文本或图像的情感不明显问题,提出了一种基于卷积神经网络(CNN)的图文融合媒体的情感分析方法。该方法融合图像特征与三个不同级别(词语级、短语级和句子级)的文本特征构建CNN模型,以分析比较不同层次的语义特征对情感预测的影响。在真实数据集上的实验结果表明,通过捕捉文本情感特征和图像情感特征之间的内部联系,可以更准确地实现对图文融合媒体情感的预测。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。 举报投诉

评论(0)

发评论

- 相关下载

- 相关文章