几种常用的NLP数据增强方法

基于OpenAI的GPT-2的语言模型ProtGPT2可生成新的蛋白质序列

基于图文多模态领域典型任务

Transformer的细节和效果如何

如何用语言模型(LM)实现建模能力

基于中文数据的标签词构造过程

预训练语言模型的字典描述

Meta开源NLLB翻译模型,支持200种语言互译

基于GPT-2进行文本生成

一文详解知识增强的语言预训练模型

万能的prompt还能做可控文本生成

GPT系列的“高仿” 最大可达GPT-3大小 自主训练

为什么要给 LM 加上神经网络?

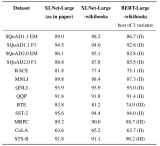

XLNet vs BERT,对比得明明白白!

XLNet和Bert比,有什么不同?要进行改进吗?

SiATL——最新、最简易的迁移学习方法

到底该怎么将这些顶尖工具用到我的模型里呢?

专家解读GPT 2.0 VS BERT!GPT 2.0到底做了什么

GPT2.0究竟是做什么的?有哪些优势和不足?未来发展趋势如何?