大型语言模型有哪些用途?大型语言模型如何运作呢?

从ChatGPT看知识管理及知识图谱的发展

使用BLIP-2 零样本“图生文”

SimANS:简单有效的困惑负样本采样方法

LLaMA论文研读:小参数+大数据的开放、高效基础语言模型阅读笔记

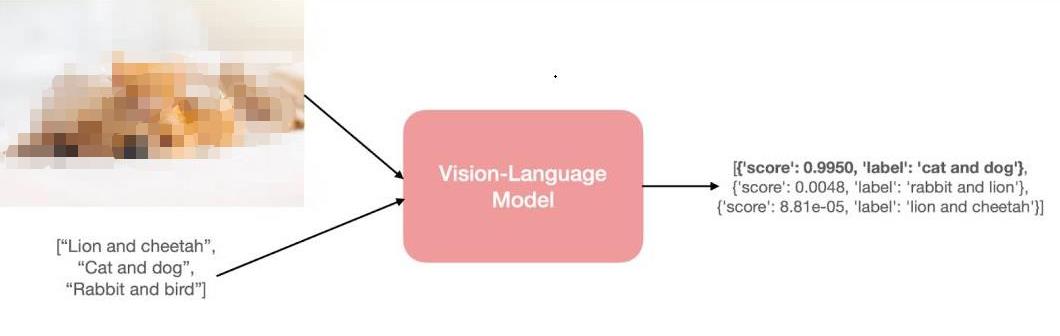

如何利用Transformers了解视觉语言模型

理解什么是NLP Subword算法

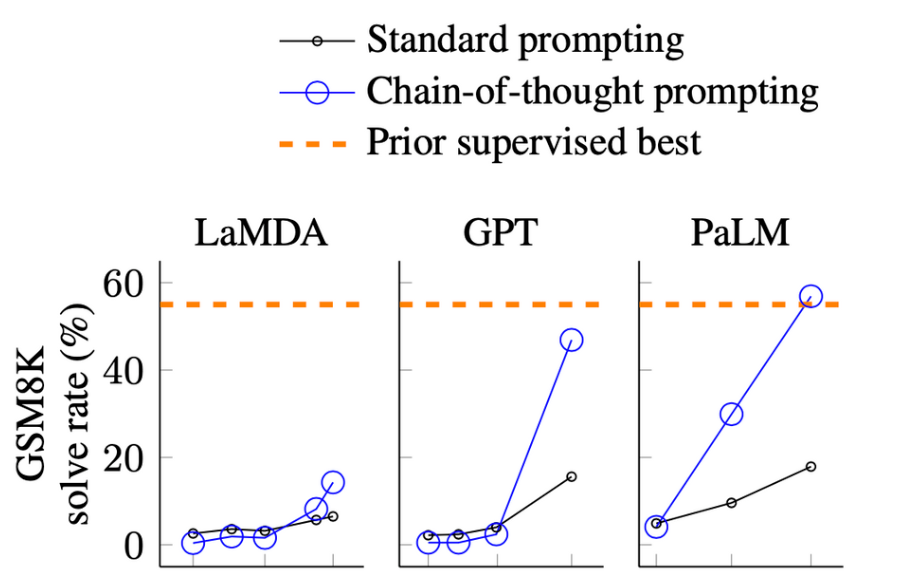

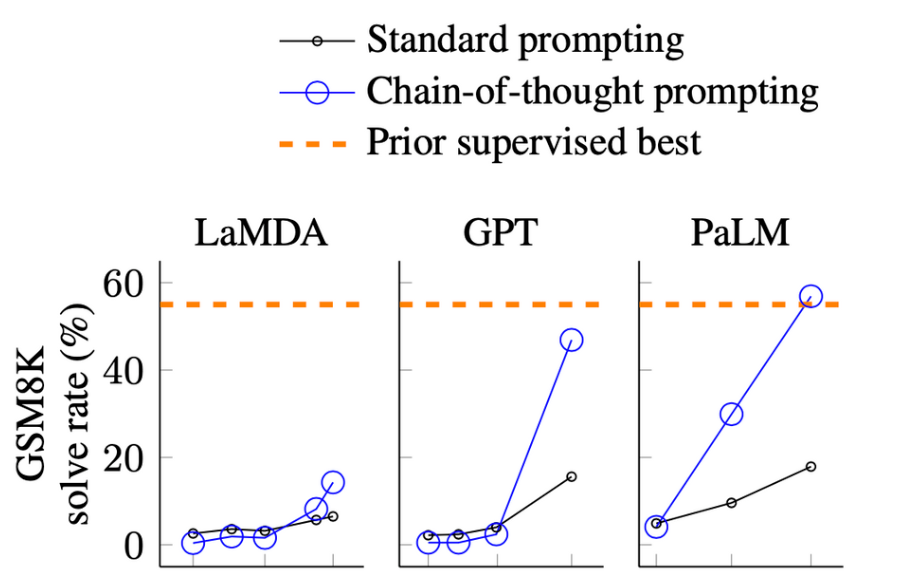

深入理解语言模型的突显能力

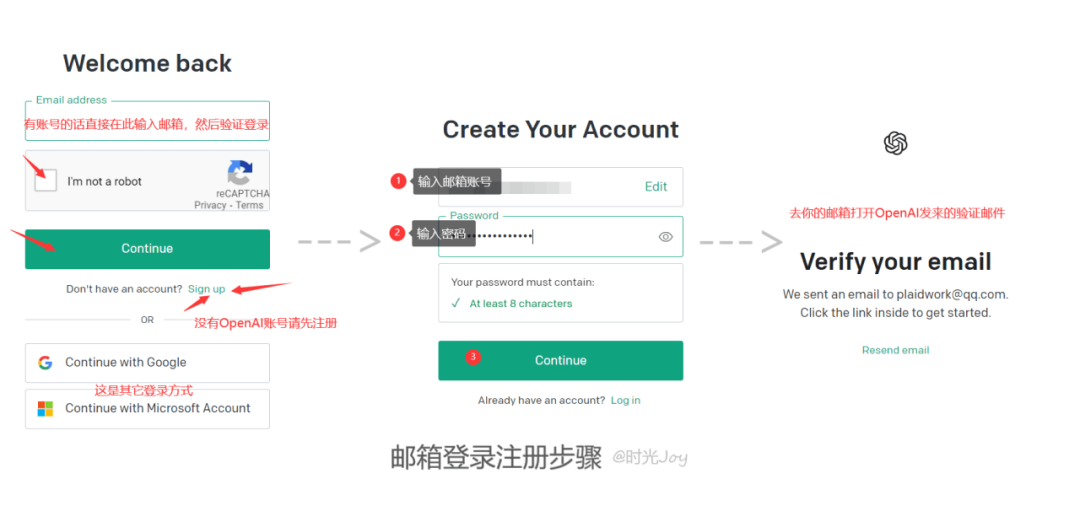

ChatGPT注册教程

解析ChatGPT的语言能力是如何训出来的(下)

解析ChatGPT的语言能力是如何训出来的(上)

解读ChatGPT背后的技术重点:RLHF、IFT、CoT、红蓝对抗

英伟达耗费64个A100训练StyleGAN-T!

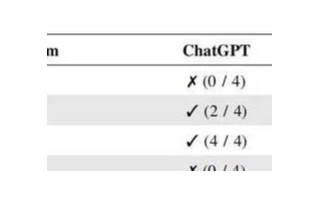

ChatGPT到底有多会修bug?

有了Fine-tune-CoT方法,小模型也能做推理,完美逆袭大模型

基于预训练语言模型的行业搜索的应用和研究

摘要模型理解或捕获输入文本的要点

一种基于prompt和对比学习的句子表征学习模型

文本噪声标签在预训练语言模型(PLMs)上的特性

基于训练阶段使用知识库+KNN检索相关信息辅助学习方法